Марков тізбегі - Markov chain

A Марков тізбегі Бұл стохастикалық модель сипаттайтын а жүйелі әр оқиғаның ықтималдығы тек алдыңғы оқиғадағы жағдайға байланысты болатын ықтимал оқиғалар туралы.[1][2][3] A шексіз тізбегі, онда тізбектің күйі дискретті уақыт қадамдарымен қозғалады, а Марков дискретті тізбегі (DTMC). A үздіксіз уақыт процесс а деп аталады үздіксіз Марков тізбегі (CTMC). Оның аты аталған Орыс математик Андрей Марков.

Марков тізбектерінің көптеген қосымшалары бар статистикалық модельдер нақты процестер,[1][4][5][6] оқу сияқты круиздік басқару жүйелері жылы автокөлік құралдары, әуежайға келетін клиенттердің кезектері немесе кезектері, валюта валюта бағамдары және жануарлар популяциясының динамикасы.[7]

Марков процестері жалпы стохастикалық модельдеу әдістерінің негізі болып табылады Марков тізбегі Монте-Карло, олар ықтималдықтың үлестірілуінен сынамаларды іріктеуді модельдеуге арналған және қолданбаны тапты Байес статистикасы, термодинамика, статистикалық механика, физика, химия, экономика, қаржы, сигналдарды өңдеу, ақпарат теориясы және жасанды интеллект.[7][8][9]

Сын есім Марковян Марков процесіне қатысты нәрсені сипаттау үшін қолданылады.[1][10]

Кіріспе

Анықтама

Марков процесі - бұл стохастикалық процесс қанағаттандыратын Марковтың меншігі[1] (кейде «ретінде сипатталадыесте сақтау қабілеті Қарапайым тілмен айтқанда, бұл болашақтағы нәтижелерге тек оның қазіргі күйіне негізделген болжамдар жасауға болатын процесс және ең бастысы - процедураның толық тарихын біле отырып жасалуы мүмкін болжамдар сияқты жақсы болжамдар.[11] Басқа сөздермен айтқанда, шартты жүйенің қазіргі жағдайы, оның болашағы және өткен күйлері туралы тәуелсіз.

Марков тізбегі - бұл дискретті Марков процесінің түрі мемлекеттік кеңістік немесе дискретті индекс жиынтығы (көбінесе уақытты білдіреді), бірақ Марков тізбегінің нақты анықтамасы әр түрлі болады.[12] Мысалы, екеуінде де Марков тізбегін Марков процесі ретінде анықтау кең таралған дискретті немесе үздіксіз уақыт есептелетін күй кеңістігімен (осылайша уақыт сипатына қарамастан),[13][14][15][16] сонымен қатар Марков тізбегін есептелетін немесе үздіксіз күй кеңістігінде (осылайша күй кеңістігіне қарамастан) дискретті уақытқа ие деп анықтау кең таралған.[12]

Марков тізбектерінің түрлері

Жүйе мемлекеттік кеңістік және уақыт параметрінің индексін көрсету керек. Келесі кестеде күй кеңістігінің жалпы деңгейлерінің әр түрлі деңгейлері үшін және әр түрлі Марков процестерінің шолу берілген дискретті уақыт v үздіксіз уақыт:

| Есептелетін мемлекеттік кеңістік | Үздіксіз немесе жалпы күй кеңістігі | |

|---|---|---|

| Дискретті уақыт | (дискретті-уақыт) Марков тізбегі есептелетін немесе ақырғы күй кеңістігінде | Марков тізбегі өлшенетін күй кеңістігінде (Мысалға, Харрис тізбегі ) |

| Үздіксіз уақыт | Үздіксіз уақыттағы Марков процесі немесе Марковтың секіру процесі | Кез келген үздіксіз стохастикалық процесс Марков қасиетімен (мысалы, Wiener процесі ) |

Марков процестерінің ерекше жағдайларын білдіретін кейбір терминдерді қолдану туралы әдебиеттерде нақты келісім жоқтығына назар аударыңыз. Әдетте «Марков тізбегі» термині дискретті уақыт жиыны бар процесс үшін сақталады, яғни а дискретті уақыттағы Марков тізбегі (DTMC),[1][17] бірақ бірнеше авторлар а сілтемесі үшін «Марков процесі» терминін қолданады үздіксіз Марков тізбегі (CTMC) нақты ескертусіз.[18][19][20] Сонымен қатар, Марков процестерінің басқа кеңейтімдері бар, олар аталған деп аталады, бірақ міндетті түрде осы төрт санаттың ешқайсысына жатпайды (қараңыз) Марков моделі ). Сонымен қатар, уақыт индексі міндетті түрде нақты бағаланбайды; жай кеңістіктегі сияқты, басқа математикалық құрылымдармен бірге индекстер жиынтығы арқылы қозғалатын процестер бар. Марков тізбегінің үздіксіз уақыттық жалпы кеңістігі қандай да бір дәрежеде жалпылама болатындығына назар аударыңыз.

Уақыт параметрі әдетте дискретті болғанымен мемлекеттік кеңістік Марков тізбегінің жалпыға бірдей келісілген шектеулері жоқ: термин ерікті күй кеңістігіндегі процесті білдіруі мүмкін.[21] Алайда, Марков тізбектерінің көптеген қосымшаларында ақырғы немесе шексіз статистикалық талдауға ие жай кеңістіктер. Уақыт индексі мен күй-кеңістік параметрлерінен басқа көптеген вариациялар, кеңейтулер мен жалпылау бар (қараңыз) Вариациялар ). Қарапайымдылық үшін, осы мақаланың көп бөлігі, егер басқаша айтылмаса, дискретті уақыт, дискретті күй-кеңістік жағдайына шоғырланған.

Өтпелі кезеңдер

Жүйе күйінің өзгеруін өтулер деп атайды.[1] Әр түрлі күй өзгерістерімен байланысты ықтималдықтар өтпелі ықтималдықтар деп аталады. Процесс мемлекеттік кеңістікпен сипатталады, а өтпелі матрица нақты өтулердің ықтималдықтарын және күй кеңістігі бойынша бастапқы күйді (немесе бастапқы үлестіруді) сипаттайтын. Шарт бойынша, біз барлық мүмкін күйлер мен ауысулар процестің анықтамасына енгізілген деп есептейміз, сондықтан әрқашан келесі күй болады, және процесс аяқталмайды.

Дискретті уақыттық кездейсоқ процесс әр сатыда белгілі бір күйде болатын, сатылар арасында күй кездейсоқ өзгеретін жүйені қамтиды.[1] Қадамдар көбінесе уақыттың сәттері ретінде қарастырылады, бірақ олар бірдей физикалық қашықтыққа немесе кез-келген басқа дискретті өлшемдерге сілтеме жасай алады. Ресми түрде қадамдар болып табылады бүтін сандар немесе натурал сандар, ал кездейсоқ процесс - бұл күйлерге кескінделуі.[22] Марковтың меншігінде ықтималдықтың шартты үлестірімі жүйе үшін келесі қадамда (және іс жүзінде барлық болашақ қадамдарда) тек жүйенің ағымдағы күйіне байланысты болады, ал алдыңғы сатылардағы жүйенің күйіне қосымша емес.

Жүйе кездейсоқ өзгеретіндіктен, болашақта Марков тізбегінің берілген нүктесінде қандай болатынын нақты болжау мүмкін емес.[22] Алайда жүйенің болашақтағы статистикалық қасиеттерін болжауға болады.[22] Көптеген қосымшаларда дәл осы статистикалық қасиеттер маңызды.

Тарих

Марков 20 ғасырдың басында Марков процестерін зерттеп, 1906 жылы осы тақырыпқа арналған алғашқы мақаласын жариялады.[23][24][25][26] Үздіксіз уақыттағы Марков процестері бұрыннан табылған Андрей Марков 20 ғасырдың басындағы жұмыс[1] түрінде Пуассон процесі.[27][28][29] Марков келіспегендіктен туындаған тәуелсіз кездейсоқ тізбектердің кеңеюін зерттеуге қызығушылық танытты Павел Некрасов тәуелсіздік үшін қажет деп мәлімдеді үлкен сандардың әлсіз заңы ұстап тұру.[1][30] Марков тізбектері туралы 1906 жылы жарияланған бірінші мақаласында Марков белгілі бір жағдайларда Марков тізбегінің орташа нәтижелері мәндердің тұрақты векторына жақындата түсетіндігін көрсетті, сондықтан тәуелсіздікке жол бермей үлкен сандардың әлсіз заңын дәлелдеді,[1][24][25][26] әдетте мұндай математикалық заңдарды сақтаудың талабы ретінде қарастырылды.[26] Кейін Марков дауысты дыбыстардың таралуын зерттеу үшін Марков тізбегін қолданды Евгений Онегин, жазылған Александр Пушкин, және дәлелдеді орталық шек теоремасы осындай тізбектер үшін.[1][24]

1912 жылы Анри Пуанкаре Марков тізбектерін зерттеді ақырғы топтар картаны араластыруды зерттеу мақсатында. Марков тізбектерінің басқа ерте қолдануларына диффузиялық модель кіреді Пауыл және Татьяна Эренфест 1907 ж. және енгізілген тармақталу процесі Фрэнсис Галтон және Генри Уильям Уотсон Марковтың жұмысынан бұрын 1873 ж.[24][25] Гальтон мен Уотсонның жұмыстарынан кейін олардың тармақталу процесін шамамен 30 жыл бұрын дербес ашқан және зерттегені анықталды. Ирени-Жюль Биенайме.[31] 1928 жылдан бастап, Морис Фречет Марков тізбектеріне қызығушылық танытып, нәтижесінде 1938 жылы Марков тізбектері туралы егжей-тегжейлі зерттеу жариялады.[24][32]

Андрей Колмогоров 1931 жылғы мақалада Марковтың үздіксіз процестерінің алғашқы теориясының едәуір бөлігі дамыды.[33][34] Колмогоров ішінара Луис Бачельедің 1900 жылғы қор нарығындағы ауытқулар жөніндегі жұмысы шабыттандырды. Норберт Винер Эйнштейн моделі бойынша жұмыс броундық қозғалыс.[33][35] Ол диффузиялық процестер деп аталатын Марков процестерінің белгілі бір жиынтығын енгізді және зерттеді, онда процестерді сипаттайтын дифференциалдық теңдеулер жиынтығын шығарды.[33][36] Колмогоровтың жұмысынан тәуелсіз, Сидней Чэпмен 1928 жылы шыққан, қазір деп аталатын теңдеу Чапман - Колмогоров теңдеуі, Колмогоровқа қарағанда аз математикалық қатаң түрде, броундық қозғалысты зерттегенде.[37] Дифференциалдық теңдеулер енді Колмогоров теңдеулері деп аталады[38] немесе Колмогоров - Чапман теңдеулері.[39] Марков процестерінің негізіне айтарлықтай үлес қосқан басқа математиктер Уильям Феллер, 1930 жылдардан бастап, содан кейін Евгений Динкин, 1950 жылдардан бастап.[34]

Мысалдар

Кездейсоқ серуендер бүтін сандарға негізделген құмар ойыншылардың қирауы мәселе - бұл Марков процестерінің мысалдары.[40][41] Бұл процестердің кейбір вариациялары жүздеген жылдар бұрын тәуелсіз айнымалылар аясында зерттелген.[42][43][44] Марков процестерінің екі маңызды мысалы: Wiener процесі, деп те аталады Броундық қозғалыс процесс және Пуассон процесі,[27] стохастикалық процестер теориясындағы ең маңызды және орталық стохастикалық процестер болып саналады.[45][46][47] Бұл екі процесс - бұл үздіксіз уақыттағы Марков процестері, ал бүтін сандарда кездейсоқ жүру және құмар ойыншылардың қирауы - бұл дискретті уақыттағы Марков процестерінің мысалдары.[40][41]

Белгілі Марков тізбегі «маскүнемдік серуен» деп аталады, кездейсоқ серуендеу сандық сызық мұндағы әр қадамда позиция бірдей ықтималдылықпен +1 немесе -1-ге өзгеруі мүмкін. Кез келген позициядан келесі немесе алдыңғы бүтін санға дейін екі ауысу болады. Өтпелі ықтималдықтар позицияға қол жеткізу тәсіліне емес, тек ағымдағы жағдайға байланысты. Мысалы, 5-тен 4-ке және 5-тен 6-ға дейінгі ауысу ықтималдығы 0,5-ке тең, ал 5-тен қалған барлық басқа ықтималдықтар 0-ге тең. Бұл ықтималдықтар жүйенің бұрын 4 немесе 6-да болғандығына тәуелсіз.

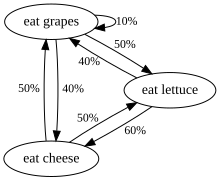

Тағы бір мысал, тек жүзім, ірімшік немесе салат жапырақтарын жейтін және диеталық әдеттері келесі ережелерге сәйкес келетін тіршілік иесінің тамақтану әдеттері:

- Ол күніне бір рет тамақтанады.

- Егер ол бүгін ірімшік жесе, ертең салат немесе жүзімді бірдей ықтималдылықпен жейді.

- Егер ол бүгін жүзім жесе, ертең 1/10 ықтималдығы бар жүзімді, 4/10 ықтималдығы бар ірімшікті және 5/10 ықтималдығы бар салатты жейді.

- Егер ол бүгін салат жапқан болса, ертең ол 4/10 ықтималдығы бар жүзімді немесе 6/10 ықтималдығы бар ірімшікті жейді. Ол ертең қайтадан салат жемейді.

Бұл тіршілік иесінің тамақтану әдеттерін Марков тізбегімен модельдеуге болады, өйткені оның ертеңгі таңдауы кеше не өткеннің басқа уақытында емес, тек бүгін не жегеніне байланысты. Есептеуге болатын бір статистикалық қасиет - бұл тіршілік иесінің жүзім жейтін күндерінің ұзақ мерзімді күтілетін пайызы.

Тәуелсіз оқиғалар тізбегі (мысалы, монеталар сериясы) Марков тізбегінің формальды анықтамасын қанағаттандырады. Алайда, теория келесі сатыдағы ықтималдықтың үлестірілуі ағымдағы күйге тәуелді болмаған жағдайда ғана қолданылады.

Марков емес мысал

Айталық, төрт квартал (әрқайсысы 25 ¢), бес дим (әрқайсысы 10 ¢) және бес никель (әрқайсысының құны 5 ¢) бар монета әмиян бар, ал бір-бірден монеталар әмияннан кездейсоқ алынған және олар үстелге қойыңыз. Егер кейін үстелге қойылған монеталардың жалпы құнын білдіреді n сурет салады , содан кейін реттілік болып табылады емес Марков процесі.

Неліктен бұлай болғанын білу үшін, алғашқы алты ойында бес никель мен ширектің бәрі тең ойналды делік. Осылайша . Егер біз жай білмесек , бірақ бұрынғы мәндер де қай монетаның салынғанын анықтай аламыз және келесі монета никель болмайтынын білеміз; сондықтан біз мұны анықтай аламыз ықтималдықпен 1. Бірақ егер біз алдыңғы мәндерді білмесек, онда тек мәнге сүйенеміз біз төрт динам және екі никель тарттық деп ойлауымыз мүмкін, бұл жағдайда келесі никельді тартуға болады. Осылайша, біздің болжамымыз дейінгі құндылықтар туралы біліміміз әсер етеді .

Алайда, бұл сценарийді Марков процесі ретінде модельдеуге болады. Анықтаудың орнына ұсыну жалпы мән үстелдегі монеталарды біз анықтай аламыз ұсыну санау үстелдегі әр түрлі монеталардың түрлері. Мысалы, 6-дан бір рет тартқаннан кейін, кестеде ширек, нөл дим және бес никель бар күйді бейнелейтін етіп анықтауға болады. Бұл жаңа модель 216 мүмкін күймен ұсынылатын болар еді (яғни 6х6х6 күй, өйткені үш монета түрінің әрқайсысы 6 ұтыс аяқталғанға дейін кестеде нөлден бес монетаға дейін болуы мүмкін). Бірінші ұтыс нәтижесі күйде болады делік . Қол жеткізу ықтималдығы енді байланысты ; мысалы, мемлекет мүмкін емес. Екінші ұтыс аяқталғаннан кейін үшінші ұтыс осы уақытқа дейін қандай монеталар ойнатылғандығына байланысты болады, бірақ енді тек бірінші күйге шығарылған монеталарға байланысты болмайды (өйткені сценарийге ықтимал маңызды ақпарат қосылды). Осылайша, ықтималдығы мемлекет тек нәтижеге байланысты мемлекет.

Ресми анықтама

Марков дискретті тізбегі

Марков дискретті тізбегі дегеніміз кездейсоқ шамалар X1, X2, X3, ... бірге Марковтың меншігі, атап айтқанда келесі күйге өту ықтималдығы алдыңғы күйлерге емес, тек қазіргі күйге байланысты:

- егер екеуі болса шартты ықтималдықтар жақсы анықталған, яғни, егер

Мүмкін мәндері Xмен а есептелетін жиынтық S тізбектің күй кеңістігі деп аталады.

Вариациялар

- Уақыт бойынша біртектес Марков тізбектері (немесе стационарлық Марков тізбектері) - бұл процестер

- барлығына n. Өту ықтималдығы тәуелді емес n.

- Марков тізбегі жадымен (немесе Марков тізбегінің тізбегі) м)

- қайда м ақырлы, қанағаттандыратын процесс

- Басқаша айтқанда, болашақ мемлекет өткенге байланысты м мемлекеттер. Тізбек құруға болады бастап Марковтың 'классикалық' қасиеті бар, ол мемлекеттік кеңістікті ретке келтіріп алады м-жастары X мәндер, яғни. .

Үздіксіз Марков тізбегі

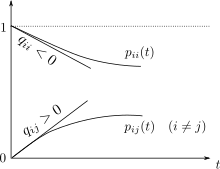

Үздіксіз Марков тізбегі (Xт)т ≥ 0 ақырғы немесе есептелетін күй кеңістігімен анықталады S, а өтпелі жылдамдық матрицасы Q күй кеңістігінің өлшемдеріне тең және жай кеңістікте анықталған ықтималдықтың алғашқы таралуы. Үшін мен ≠ j, элементтері qиж теріс емес және күйден өту процесінің жылдамдығын сипаттайды мен мемлекетке j. Элементтер qII өтпелі жылдамдық матрицасының әр жолы нөлге тең болатындай етіп таңдалады, ал а (дискретті) Марков тізбегіндегі ықтималдықтың ауысу матрицасының жолдарының қосындылары барлығы бірдей болады.

Процестің үш баламалы анықтамасы бар.[48]

Шексіз анықтама

Келіңіздер уақыттың күйін сипаттайтын кездейсоқ шама болуы керек т, және процесті бір күйде деп қабылдаңыз мен уақытта т. Содан кейін, біле отырып , алдыңғы мәндерге тәуелсіз , және сағ → 0 барлығына арналған j және бәріне т,

- ,

қайда болып табылады Kronecker атырауы, пайдаланып аз-о белгілері мәтіндері көшудің қаншалықты тез өтетінін өлшеу ретінде қарастыруға болады мен дейін j болады.

Секіру тізбегі / ұстау уақытын анықтау

Марков дискретті тізбегін анықтаңыз Yn сипаттау nпроцестің секірісі және айнымалылар S1, S2, S3, ... қай мемлекеттерде өткізілетін уақытты сипаттау Sмен жылдамдық параметрімен экспоненциалды үлестіру жүреді -qYменYмен.

Өту ықтималдығының анықтамасы

Кез келген мән үшін n = 0, 1, 2, 3, ... және осы мәнге дейін индекстелген уақыт n: т0, т1, т2, ... және осы уақытта жазылған барлық күйлер мен0, мен1, мен2, мен3, ... оны ұстайды

қайда биж шешімі болып табылады алға теңдеу (а бірінші ретті дифференциалдық теңдеу )

бастапқы шарты P (0) болып табылады сәйкестік матрицасы.

Соңғы мемлекеттік кеңістік

Егер мемлекеттік кеңістік болса ақырлы, өтпелі ықтималдықтың үлестірілуін а түрінде ұсынуға болады матрица, өтпелі матрица деп аталады,мен, j) мың элемент туралы P тең

Әр қатарынан бастап P қосындылар бірге және барлық элементтер теріс емес, P Бұл оң стохастикалық матрица.

Меншікті векторларға және қарапайымдарға қатысты стационарлық үлестіру қатынасы

Стационарлық үлестіру π - жазбалары теріс емес және 1-ге қосылатын, ауысу матрицасының әрекетімен өзгермейтін (жол) вектор. P оған және сол арқылы анықталады

Осы анықтаманы және меншікті вектор біз екі ұғымның өзара байланысты екенін көреміз

қалыпқа келтірілген () сол жақ вектордың еселігі e өтпелі матрицаның P бірге өзіндік құндылық Егер меншікті вектордың бірлігі көп болса, онда сәйкес стационар күйлердің өлшенген қосындысы да стационар күй болады. Бірақ Марков тізбегі үшін көбінесе стационарлық күй қызықтырады, бұл кейбір алғашқы үлестірулер үшін тарату реттілігінің шегі.

Стационарлық үлестірім мәні мемлекет кеңістігімен байланысты P және оның меншікті векторлары салыстырмалы пропорцияларында сақталған. Π компоненттері оң болғандықтан, олардың қосындысы бірлік болатын шектеуді келесі түрде жазуға болады Компоненттері 1 болатын векторы бар π нүктелік көбейтіндісі бірлік екенін және π а-ға жататындығын көреміз қарапайым.

Шекті күй кеңістігі бар біртекті Марков тізбегі

Бұл бөлім а қолданылған әдебиеттер тізімі, байланысты оқу немесе сыртқы сілтемелер, бірақ оның көздері түсініксіз болып қалады, өйткені ол жетіспейді кірістірілген дәйексөздер. (Ақпан 2012) (Бұл шаблон хабарламасын қалай және қашан жою керектігін біліп алыңыз) |

Егер Марков тізбегі уақыт бойынша біртекті болса, онда өтпелі матрица P әр қадамнан кейін бірдей, сондықтан к-адамның ауысу ықтималдығын ретінде есептеуге болады к- өтпелі матрицаның қуаты, Pк.

Егер Марков тізбегі төмендетілмейтін және апериодты болса, онда бірегей стационарлық үлестіру бар π.[49] Сонымен қатар, бұл жағдайда Pк әрбір қатар стационарлық үлестірім болып табылатын дәрежелік матрицаға жақындайды π:

қайда 1 - бұл барлық жазбалары 1-ге тең баған векторы. Бұл Перрон-Фробениус теоремасы. Егер қандай болса да, табылды, содан кейін қарастырылып отырған Марков тізбегінің стационарлық таралуын кез-келген бастапқы тарату үшін оңай анықтауға болады, өйткені төменде түсіндіріледі.

Кейбір стохастикалық матрицалар үшін P, шегі жоқ, мысалы, стационарлық үлестірім, мысалы, көрсетілгендей:

(Бұл мысал мерзімді Марков тізбегін бейнелейді.)

Әр түрлі ерекше жағдайларды қарастыру қажет болғандықтан, егер ол бар болса, бұл шекті табу процесі ұзақ уақытқа созылатын тапсырма болуы мүмкін. Алайда, бұл шекті табуға көмектесетін көптеген әдістер бар. Келіңіздер P болуы n×n матрица және анықтаңыз

Бұл әрқашан шындық

Шығару Q екі жағынан және факторинг нәтиже береді

қайда Менn болып табылады сәйкестік матрицасы өлшемі n, және 0n,n болып табылады нөлдік матрица өлшемі n×n. Біріктірілген стохастикалық матрицалар әрқашан басқа стохастикалық матрица береді, сондықтан Q болуы керек стохастикалық матрица (жоғарыдағы анықтаманы қараңыз). Кейде жоғарыда келтірілген матрицалық теңдеуді қолдану жеткілікті Q шешуге болатын стохастикалық матрица болып табылады Q. Оның ішінде әр жолдың қосындысы P 1, бар n + 1 анықтауға арналған теңдеулер n белгісіз, сондықтан бір жағынан бір жолды таңдаса, есептеу оңайырақ болады Q және оның элементтерінің әрқайсысын бірімен алмастырады, ал екіншісінде вектордағы сәйкес элементті (сол бағандағы біреуін) ауыстырады 0, ал келесі сол векторды табу үшін өзгертілген бұрынғы матрицаның кері бағытына осы соңғы векторды көбейтеді Q.

Мұны істеудің бір әдісі: алдымен функцияны анықтаңыз f(A) матрицаны қайтару үшін A оның оң жақтағы бағанының барлығы 1-ге ауыстырылды. Егер [f(P − Менn)]−1 ол кезде бар[50][49]

- Түсіндіріңіз: бастапқы матрица теңдеуі а-ға тең n × n сызықтық теңдеулер жүйесі n × n айнымалыларда. Және Q-ның дұрыс екендігі туралы тағы n сызықтық теңдеулер бар стохастикалық матрица әрқайсысының жолы 1-ге тең. Сондықтан оған n × n айнымалылар үшін шешу үшін (n × n + n) теңдеулердің кез келген n × n тәуелсіз сызықтық теңдеулері қажет. Бұл мысалда n теңдеулер «Q оң жақ бағанға көбейтілген (P-In)» n-стохастикалық теңдеулермен ауыстырылды.

Назар аударатын бір нәрсе - егер P элементі бар Pмен,мен оның негізгі диагоналінде 1-ге тең менүшінші жол немесе баған басқаша 0-мен толтырылады, содан кейін бұл жол немесе баған кейінгі барлық күштерде өзгеріссіз қалады Pк. Демек, мен-ші жол немесе баған Q 1 мен 0 мәндері дәл сол күйінде болады P.

Стационарлық үлестіруге конвергенция жылдамдығы

Бұл бөлім а қолданылған әдебиеттер тізімі, байланысты оқу немесе сыртқы сілтемелер, бірақ оның көздері түсініксіз болып қалады, өйткені ол жетіспейді кірістірілген дәйексөздер. (Ақпан 2012) (Бұл шаблон хабарламасын қалай және қашан жою керектігін біліп алыңыз) |

Бұрын айтылғандай, теңдеуден (егер бар болса) стационарлық (немесе тұрақты) үлестіру π қатардың сол жақ векторы стохастикалық матрица P. Одан кейін P диагонализацияланатын немесе оған тең P бар n сызықты тәуелсіз меншікті векторлар, конвергенция жылдамдығы келесідей өңделген. (Диагонализацияланбайтындар үшін, яғни ақаулы матрицалар, біреуінен басталуы мүмкін Иордания қалыпты формасы туралы P және осыған ұқсас дәлелдер жиынтығын жалғастырыңыз.[51]

Келіңіздер U меншікті векторлардың матрицасы болыңыз (әрқайсысы L2 нормасы 1-ге теңестірілген), мұнда әрбір баған сол жақ меншікті вектор болып табылады P және рұқсат етіңіз Σ сол жақтың жеке мәндерінің диагональ матрицасы болыңыз P, Бұл, Σ = диагон (λ1,λ2,λ3,...,λn). Содан кейін өзіндік композиция

Меншікті мәндерді санайық:

Бастап P қатарлы стохастикалық матрица, оның сол жақтағы ең үлкен мәні - 1, егер бірегей стационарлық үлестірім болса, онда ең үлкен меншікті меншікті вектор да ерекше болады (өйткені басқа π стационарлық үлестіру теңдеуін шешеді). Келіңіздер сенмен болуы мен- баған U матрица, яғни сенмен - сол жақ векторы P λ сәйкес келедімен. Сондай-ақ рұқсат етіңіз х ұзындық n ықтималдықтың дұрыс бөлінуін білдіретін жол векторы; меншікті векторлардан бастап сенмен аралық біз жаза аламыз

Егер біз көбейтсек х бірге P оң жақтан және осы операцияны нәтижелерімен жалғастырыңыз, соңында біз стационарлық үлестірімді аламыз π. Басқа сөздермен айтқанда, π = сенмен ← xPP...P = xPк сияқты к → ∞. Бұл дегеніміз

Бастап π = сен1, π(к) тәсілдері π сияқты к → ∞ жылдамдықпен λ2/λ1 экспоненциалды. Бұл келесіге байланысты демек λ2/λ1 басым термин болып табылады. Мемлекеттік таралу кезіндегі кездейсоқ шу π сонымен қатар бұл конвергенцияны стационарлық үлестіруге жеделдете алады.[52]

Жалпы мемлекеттік кеңістік

Харрис тізбектері

Шектеулі күй кеңістігі бар Марков тізбегінің көптеген нәтижелерін санауға болмайтын күй кеңістігі бар тізбектерге жалпылауға болады Харрис тізбектері. Негізгі идея - күй кеңістігінде тізбектің ықтималдықпен соғатын нүктесі бар-жоғын білу. Әдетте, бұл тұрақты күй кеңістігі үшін дұрыс емес, дегенмен жиындарды анықтай аламыз A және B оң санмен бірге ε және ықтималдық өлшемі ρ, осылай

Сонда біз жиынтықтарды көмекші нүктеге айналдыра аламыз α, және қайталанатын Харрис тізбегі ішіне өзгертуге болады α. Соңында, Харрис тізбектері жалпылаудың ыңғайлы деңгейі, ол көптеген қызықты мысалдарды қамтуға жеткілікті, бірақ бай теорияға мүмкіндік беретін шектеулі.

Марков тізбектерін Марке тізбегінде Монте-Карло әдістерін қолдану процесс үздіксіз күй кеңістігінде жүретін жағдайларды қамтиды.

Жергілікті өзара әрекеттесетін Марков тізбектері

Марков тізбектерінің жиынтығын қарастыру, оның эволюциясы басқа Марков тізбектерінің күйін ескереді, деген түсінікпен байланысты жергілікті өзара әрекеттесетін Марков тізбектері. Бұл мемлекеттік кеңістіктің (декарттық-) өнім формасы болған жағдайға сәйкес келеді өзара әрекеттесетін бөлшектер жүйесі және стохастикалық ұялы автоматтар Мысалы, қараңыз Марков процестерінің өзара әрекеттесуі[53]немесе[54]

Қасиеттері

Екі күй бір-бірімен байланысады, егер екеуіне бір-біріне оң ықтималдығы бар ауысулар тізбегі арқылы қол жетімді болса. Бұл қарым-қатынас жасайтын сыныптардың жиынтығын беретін эквиваленттік қатынас. Егер сыныптан шығу ықтималдығы нөлге тең болса, класс жабық болады. Марков тізбегі, егер байланыс жасайтын бір сынып, мемлекеттік кеңістік болса, алынбайды.

Мемлекет мен кезеңі бар егер болып табылады ең үлкен ортақ бөлгіш өтпелер саны мен бастап жетуге болады мен. Бұл:

Мемлекет мен бастап басталатын болса, өтпелі деп аталады мен, тізбектің ешқашан оралмайтын нөлге тең емес ықтималдығы бар мен. Ол басқаша қайталанады. Қайталанатын күй үшін мен, соғудың орташа уақыты келесідей анықталады:

Мемлекет мен егер оң қайталанатын болса ақырлы және әйтпесе нөлдік қайталанатын болады. Периодтылық, өтпелілік, қайталану және позитивті және нөлдік қайталану - бұл сыныптық қасиеттер, яғни егер бір күй қасиетке ие болса, онда оның байланыс жасайтын класындағы барлық күйлер қасиетке ие.

Мемлекет мен күйден шығатын өтпелер болмаса, сіңіру деп аталады.

Эргодика

Мемлекет мен деп айтылады эргодикалық егер бұл апериодты және позитивті қайталанатын болса. Басқаша айтқанда, мемлекет мен эргодикалық болып табылады, егер ол қайталанатын болса, периоды бар 1, және соңғы орташа қайталану уақыты бар. Егер Марков тізбегіндегі барлық күйлер эргодикалық болса, онда тізбек эргодикалық деп аталады.[күмәнді ]

Марковтың шектеулі тізбегі апериодтық күйге ие болса, эргодикалық болып табылады. Жалпы, егер Марков тізбегі эргодикалық болып табылады, егер сан болса N кез келген күйге кез келген басқа күйден санға кем немесе тең қадамдардың кез келген санында жетуге болатындай етіп N. Толық байланысқан өтпелі матрица жағдайында, егер барлық өтулер нөлдік емес ықтималдығы болса, онда бұл шарт орындаладыN = 1.

Марков тізбегі бірнеше күйге ие және бір күйге бір ғана ауыспалы ауыспалы немесе апериодтық емес, сондықтан эргодикалық бола алмайды.

Марковтық өкілдіктер

Кейбір жағдайларда, мүмкін, марковтық емес процестерде «қазіргі» және «болашақ» күйлерінің тұжырымдамасын кеңейту жолымен құрылған марковтық өкілдіктер болуы мүмкін. Мысалы, рұқсат етіңіз X Марковтық емес процесс болыңыз. Содан кейін процесті анықтаңыз Y, әр күйі Y күйлерінің уақыт аралығын білдіреді X. Математикалық тұрғыдан бұл келесі түрде болады:

Егер Y Марковтың қасиетіне ие болса, онда ол марковтық көрініс X.

Марковтық өкілдігі бар марковтық емес процестің мысалы болып табылады авторегрессивті уақыт қатары реті бірден үлкен.[55]

Соққы уақыттары

Соққы уақыты - бұл берілген күйлер жиынтығынан бастап, тізбек берілген күйге немесе күйлер жиынтығына келгенге дейінгі уақыт. Мұндай уақыт кезеңінің таралуы фазалық типтік үлестірілімге ие. Мұндай қарапайым үлестіру - экспоненциалды түрде бөлінген бір ауысу.

Ұрыс уақыты күтілуде

Күйлердің жиынтығы үшін A ⊆ S, вектор кA соққы уақыты (бұл жерде элемент білдіреді күтілетін мән күйінен басталады мен бұл тізбектің жиынтықтағы күйлердің біріне енетіндігі A) - минималды теріс емес шешім[56]

Уақытты өзгерту

CTMC үшін Xт, уақыттың кері процесі анықталды . Авторы Келли леммасы бұл үдеріс форвард процесі сияқты стационарлық үлестіруге ие.

Егер тізбектің қайтымды болатындығы, егер кері процесс алға жылжумен бірдей болса, болады. Колмогоров критерийі процестің қайтымды болуы үшін қажетті және жеткілікті шарт тұйық контур айналасындағы өтпелі жылдамдықтардың көбейтіндісі екі бағытта бірдей болуы керек екенін айтады.

Марков тізбегі

Табудың бір әдісі ықтималдықтың стационарлық таралуы, π, ан эргодикалық үздіксіз Марков тізбегі, Q, алдымен оны табу ендірілген Марков тізбегі (EMC). Қатаң түрде ОӘК - бұл дискретті уақытты Марков тізбегі, кейде оны а деп атайды секіру процесі. ОӘК бір қадамдық ықтималдық матрицасының әрбір элементі, S, деп белгіленеді сиж, және білдіреді шартты ықтималдылық мемлекеттен ауысу мен мемлекетке j. Бұл шартты ықтималдықтар бойынша табылуы мүмкін

Осыдан, S ретінде жазылуы мүмкін

қайда Мен болып табылады сәйкестік матрицасы және диаграмма (Q) болып табылады қиғаш матрица таңдау арқылы қалыптасады негізгі диагональ матрицадан Q және барлық басқа элементтерді нөлге теңестіру.

Ықтималдықтың үлестірім векторын табу үшін келесі жолды табу керек осындай

бірге барлық векторлар болатындай векторлық вектор бола алады 0-ден үлкен = 1. Осыдан, π ретінде табылуы мүмкін

(S мүмкін болса да, мерзімді болуы мүмкін Q емес. Бір рет π табылды, оны а дейін қалыпқа келтіру керек бірлік векторы.)

Үздіксіз Марков тізбегінен алынуы мүмкін тағы бір дискретті уақыт процесі - δ-қаңқа - бақылаудан пайда болған (дискретті уақыттағы) Марков тізбегі X(т) уақыт бірлігінің аралықтарында. Кездейсоқ шамалар X(0), X(δ),X(2δ), ... give the sequence of states visited by the δ-skeleton.

Special types of Markov chains

Марков моделі

Markov models are used to model changing systems. There are 4 main types of models, that generalize Markov chains depending on whether every sequential state is observable or not, and whether the system is to be adjusted on the basis of observations made:

| System state is fully observable | System state is partially observable | |

|---|---|---|

| System is autonomous | Марков тізбегі | Марковтың жасырын моделі |

| System is controlled | Марков шешім қабылдау процесі | Partially observable Markov decision process |

Bernoulli scheme

A Bernoulli scheme is a special case of a Markov chain where the transition probability matrix has identical rows, which means that the next state is even independent of the current state (in addition to being independent of the past states). A Bernoulli scheme with only two possible states is known as a Бернулли процесі.

Note, however, by the Ornstein isomorphism theorem, that every aperiodic and irreducible Markov chain is isomorphic to a Bernoulli scheme;[57] thus, one might equally claim that Markov chains are a "special case" of Bernoulli schemes. The isomorphism generally requires a complicated recoding. The isomorphism theorem is even a bit stronger: it states that кез келген stationary stochastic process is isomorphic to a Bernoulli scheme; the Markov chain is just one such example.

Subshift of finite type

When the Markov matrix is replaced by the матрица а finite graph, the resulting shift is terms a topological Markov chain немесе а subshift of finite type.[57] A Markov matrix that is compatible with the adjacency matrix can then provide a өлшеу on the subshift. Many chaotic динамикалық жүйелер are isomorphic to topological Markov chains; мысалдар жатады диффеоморфизмдер туралы closed manifolds, Prouhet–Thue–Morse system, Chacon system, sofic systems, context-free systems және block-coding systems.[57]

Қолданбалар

Research has reported the application and usefulness of Markov chains in a wide range of topics such as physics, chemistry, biology, medicine, music, game theory and sports.

Физика

Markovian systems appear extensively in термодинамика және статистикалық механика, whenever probabilities are used to represent unknown or unmodelled details of the system, if it can be assumed that the dynamics are time-invariant, and that no relevant history need be considered which is not already included in the state description.[58][59] For example, a thermodynamic state operates under a probability distribution that is difficult or expensive to acquire. Therefore, Markov Chain Monte Carlo method can be used to draw samples randomly from a black-box to approximate the probability distribution of attributes over a range of objects.[59]

The paths, in the path integral formulation of quantum mechanics, are Markov chains.[60]

Markov chains are used in lattice QCD simulations.[61]

Химия

A reaction network is a chemical system involving multiple reactions and chemical species. The simplest stochastic models of such networks treat the system as a continuous time Markov chain with the state being the number of molecules of each species and with reactions modeled as possible transitions of the chain.[62] Markov chains and continuous-time Markov processes are useful in chemistry when physical systems closely approximate the Markov property. For example, imagine a large number n of molecules in solution in state A, each of which can undergo a chemical reaction to state B with a certain average rate. Perhaps the molecule is an enzyme, and the states refer to how it is folded. The state of any single enzyme follows a Markov chain, and since the molecules are essentially independent of each other, the number of molecules in state A or B at a time is n times the probability a given molecule is in that state.

The classical model of enzyme activity, Михаэлис-Ментен кинетикасы, can be viewed as a Markov chain, where at each time step the reaction proceeds in some direction. While Michaelis-Menten is fairly straightforward, far more complicated reaction networks can also be modeled with Markov chains.[63]

An algorithm based on a Markov chain was also used to focus the fragment-based growth of chemicals кремнийде towards a desired class of compounds such as drugs or natural products.[64] As a molecule is grown, a fragment is selected from the nascent molecule as the "current" state. It is not aware of its past (that is, it is not aware of what is already bonded to it). It then transitions to the next state when a fragment is attached to it. The transition probabilities are trained on databases of authentic classes of compounds.[65]

Also, the growth (and composition) of сополимерлер may be modeled using Markov chains. Based on the reactivity ratios of the monomers that make up the growing polymer chain, the chain's composition may be calculated (for example, whether monomers tend to add in alternating fashion or in long runs of the same monomer). Байланысты steric effects, second-order Markov effects may also play a role in the growth of some polymer chains.

Similarly, it has been suggested that the crystallization and growth of some epitaxial superlattice oxide materials can be accurately described by Markov chains.[66]

Биология

Markov chains are used in various areas of biology. Көрнекті мысалдарға мыналар жатады:

- Филогенетика және биоинформатика, where most models of DNA evolution use continuous-time Markov chains to describe the нуклеотид present at a given site in the геном.

- Популяция динамикасы, where Markov chain are in particular a central tool in the theoretical study of matrix population models.

- Нейробиология, where Markov chains have been used, e.g, to simulate the mammalian neocortex.[67]

- Жүйелік биология, for instance with the modeling of viral infection of single cells.[68]

- Compartmental models for disease outbreak and epidemic modeling.

Тестілеу

Several theorists have proposed the idea of the Markov chain statistical test (MCST), a method of conjoining Markov chains to form a "Марков көрпесі ", arranging these chains in several recursive layers ("wafering") and producing more efficient test sets—samples—as a replacement for exhaustive testing. MCSTs also have uses in temporal state-based networks; Chilukuri et al.'s paper entitled "Temporal Uncertainty Reasoning Networks for Evidence Fusion with Applications to Object Detection and Tracking" (ScienceDirect) gives a background and case study for applying MCSTs to a wider range of applications.

Solar irradiance variability

Solar irradiance variability assessments are useful for күн энергиясы қосымшалар. Solar irradiance variability at any location over time is mainly a consequence of the deterministic variability of the sun's path across the sky dome and the variability in cloudiness. The variability of accessible solar irradiance on Earth's surface has been modeled using Markov chains,[69][70][71][72] also including modeling the two states of clear and cloudiness as a two-state Markov chain.[73][74]

Сөйлеуді тану

Hidden Markov models are the basis for most modern сөйлеуді автоматты түрде тану жүйелер.

Information and computer science

Markov chains are used throughout information processing. Клод Шеннон 's famous 1948 paper Қарым-қатынастың математикалық теориясы, which in a single step created the field of ақпарат теориясы, opens by introducing the concept of энтропия through Markov modeling of the English language. Such idealized models can capture many of the statistical regularities of systems. Even without describing the full structure of the system perfectly, such signal models can make possible very effective деректерді қысу арқылы энтропияны кодтау сияқты техникалар арифметикалық кодтау. They also allow effective state estimation және үлгіні тану. Markov chains also play an important role in арматуралық оқыту.

Markov chains are also the basis for hidden Markov models, which are an important tool in such diverse fields as telephone networks (which use the Viterbi алгоритмі for error correction), speech recognition and биоинформатика (such as in rearrangements detection[75]).

The LZMA lossless data compression algorithm combines Markov chains with Lempel-Ziv compression to achieve very high compression ratios.

Кезек теориясы

Markov chains are the basis for the analytical treatment of queues (кезек теориясы ). Agner Krarup Erlang initiated the subject in 1917.[76] This makes them critical for optimizing the performance of telecommunications networks, where messages must often compete for limited resources (such as bandwidth).[77]

Numerous queueing models use continuous-time Markov chains. Мысалы, ан M/M/1 queue is a CTMC on the non-negative integers where upward transitions from мен дейін мен + 1 occur at rate λ according to a Пуассон процесі and describe job arrivals, while transitions from мен дейін мен – 1 (for мен > 1) occur at rate μ (job service times are exponentially distributed) and describe completed services (departures) from the queue.

Internet applications

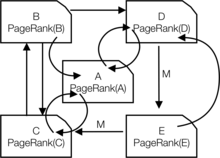

The PageRank of a webpage as used by Google is defined by a Markov chain.[78][79][80] It is the probability to be at page in the stationary distribution on the following Markov chain on all (known) webpages. Егер is the number of known webpages, and a page бар links to it then it has transition probability for all pages that are linked to and for all pages that are not linked to. Параметр is taken to be about 0.15.[81]

Markov models have also been used to analyze web navigation behavior of users. A user's web link transition on a particular website can be modeled using first- or second-order Markov models and can be used to make predictions regarding future navigation and to personalize the web page for an individual user.

Статистика

Markov chain methods have also become very important for generating sequences of random numbers to accurately reflect very complicated desired probability distributions, via a process called Markov chain Monte Carlo (MCMC). In recent years this has revolutionized the practicability of Байес қорытындысы methods, allowing a wide range of posterior distributions to be simulated and their parameters found numerically.

Экономика және қаржы

Markov chains are used in finance and economics to model a variety of different phenomena, including asset prices and market crashes. The first financial model to use a Markov chain was from Prasad т.б. 1974 ж.[күмәнді ][82] Another was the regime-switching model of Джеймс Д. Гамильтон (1989), in which a Markov chain is used to model switches between periods high and low GDP growth (or alternatively, economic expansions and recessions).[83] A more recent example is the Markov switching multifractal моделі Laurent E. Calvet and Adlai J. Fisher, which builds upon the convenience of earlier regime-switching models.[84][85] It uses an arbitrarily large Markov chain to drive the level of volatility of asset returns.

Dynamic macroeconomics heavily uses Markov chains. An example is using Markov chains to exogenously model prices of equity (stock) in a жалпы тепе-теңдік параметр.[86]

Credit rating agencies produce annual tables of the transition probabilities for bonds of different credit ratings.[87]

Қоғамдық ғылымдар

Markov chains are generally used in describing path-dependent arguments, where current structural configurations condition future outcomes. An example is the reformulation of the idea, originally due to Карл Маркс Келіңіздер Das Kapital, байлау экономикалық даму to the rise of капитализм. In current research, it is common to use a Markov chain to model how once a country reaches a specific level of economic development, the configuration of structural factors, such as size of the Орта сынып, the ratio of urban to rural residence, the rate of саяси mobilization, etc., will generate a higher probability of transitioning from авторитарлық дейін democratic regime.[88]

Ойындар

Markov chains can be used to model many games of chance.[1] The children's games Жыландар мен баспалдақтар және »Сәлем, Хо! Шие-О ", for example, are represented exactly by Markov chains. At each turn, the player starts in a given state (on a given square) and from there has fixed odds of moving to certain other states (squares).

Музыка

Markov chains are employed in algorithmic music composition, әсіресе бағдарламалық жасақтама сияқты Cound, Макс, және SuperCollider. In a first-order chain, the states of the system become note or pitch values, and a probability vector for each note is constructed, completing a transition probability matrix (see below). An algorithm is constructed to produce output note values based on the transition matrix weightings, which could be MIDI note values, frequency (Hz ), or any other desirable metric.[89]

| Ескерту | A | C♯ | E♭ |

|---|---|---|---|

| A | 0.1 | 0.6 | 0.3 |

| C♯ | 0.25 | 0.05 | 0.7 |

| E♭ | 0.7 | 0.3 | 0 |

| Ескертулер | A | Д. | G |

|---|---|---|---|

| АА | 0.18 | 0.6 | 0.22 |

| AD | 0.5 | 0.5 | 0 |

| AG | 0.15 | 0.75 | 0.1 |

| ДД | 0 | 0 | 1 |

| DA | 0.25 | 0 | 0.75 |

| DG | 0.9 | 0.1 | 0 |

| GG | 0.4 | 0.4 | 0.2 |

| GA | 0.5 | 0.25 | 0.25 |

| GD | 1 | 0 | 0 |

A second-order Markov chain can be introduced by considering the current state және also the previous state, as indicated in the second table. Higher, nth-order chains tend to "group" particular notes together, while 'breaking off' into other patterns and sequences occasionally. These higher-order chains tend to generate results with a sense of фразалық structure, rather than the 'aimless wandering' produced by a first-order system.[90]

Markov chains can be used structurally, as in Xenakis's Analogique A and B.[91] Markov chains are also used in systems which use a Markov model to react interactively to music input.[92]

Usually musical systems need to enforce specific control constraints on the finite-length sequences they generate, but control constraints are not compatible with Markov models, since they induce long-range dependencies that violate the Markov hypothesis of limited memory. In order to overcome this limitation, a new approach has been proposed.[93]

Бейсбол

Markov chain models have been used in advanced baseball analysis since 1960, although their use is still rare. Each half-inning of a baseball game fits the Markov chain state when the number of runners and outs are considered. During any at-bat, there are 24 possible combinations of number of outs and position of the runners. Mark Pankin shows that Markov chain models can be used to evaluate runs created for both individual players as well as a team.[94]He also discusses various kinds of strategies and play conditions: how Markov chain models have been used to analyze statistics for game situations such as түйреуіш және ұрлау and differences when playing on grass vs. AstroTurf.[95]

Марков мәтін генераторлары

Markov processes can also be used to generate superficially real-looking text given a sample document. Markov processes are used in a variety of recreational "parody generator " software (see dissociated press, Jeff Harrison,[96] Mark V. Shaney,[97][98] and Academias Нейтроний ). Several open-source text generation libraries using Markov chains exist, including The RiTa Toolkit.

Probabilistic forecasting

Markov chains have been used for forecasting in several areas: for example, price trends,[99] wind power,[100] and solar irradiance.[101] The Markov chain forecasting models utilize a variety of settings, from discretizing the time series,[100] to hidden Markov models combined with wavelets,[99] and the Markov chain mixture distribution model (MCM).[101]

Сондай-ақ қараңыз

- Dynamics of Markovian particles

- Гаусс-Марков процесі

- Markov chain approximation method

- Markov chain geostatistics

- Markov chain mixing time

- Марков шешім қабылдау процесі

- Markov information source

- Markov odometer

- Марков кездейсоқ өріс

- Quantum Markov chain

- Semi-Markov process

- Stochastic cellular automaton

- Telescoping Markov chain

- Variable-order Markov model

Ескертулер

- ^ а б c г. e f ж сағ мен j к л Gagniuc, Paul A. (2017). Markov Chains: From Theory to Implementation and Experimentation. USA, NJ: John Wiley & Sons. pp. 1–235. ISBN 978-1-119-38755-8.

- ^ "Markov chain | Definition of Markov chain in US English by Oxford Dictionaries". Оксфорд сөздіктері | Ағылшын. Алынған 2017-12-14.

- ^ Definition at Brilliant.org "Brilliant Math and Science Wiki". Retrieved on 12 May 2019

- ^ Samuel Karlin; Howard E. Taylor (2 December 2012). A First Course in Stochastic Processes. Академиялық баспасөз. б. 47. ISBN 978-0-08-057041-9. Мұрағатталды from the original on 23 March 2017.

- ^ Bruce Hajek (12 March 2015). Random Processes for Engineers. Кембридж университетінің баспасы. ISBN 978-1-316-24124-0. Мұрағатталды from the original on 23 March 2017.

- ^ G. Latouche; V. Ramaswami (1 January 1999). Introduction to Matrix Analytic Methods in Stochastic Modeling. СИАМ. 4–4 бет. ISBN 978-0-89871-425-8. Мұрағатталды from the original on 23 March 2017.

- ^ а б Sean Meyn; Richard L. Tweedie (2 April 2009). Markov Chains and Stochastic Stability. Кембридж университетінің баспасы. б. 3. ISBN 978-0-521-73182-9. Мұрағатталды from the original on 23 March 2017.

- ^ Reuven Y. Rubinstein; Dirk P. Kroese (20 September 2011). Simulation and the Monte Carlo Method. Джон Вили және ұлдары. б. 225. ISBN 978-1-118-21052-9. Мұрағатталды from the original on 23 March 2017.

- ^ Dani Gamerman; Hedibert F. Lopes (10 May 2006). Markov Chain Monte Carlo: Stochastic Simulation for Bayesian Inference, Second Edition. CRC Press. ISBN 978-1-58488-587-0. Мұрағатталды from the original on 23 March 2017.

- ^ "Markovian". Оксфорд ағылшын сөздігі (Интернеттегі ред.). Оксфорд университетінің баспасы. (Жазылым немесе қатысушы мекемеге мүшелік қажет.)

- ^ Øksendal, B. K. (Bernt Karsten) (2003). Stochastic differential equations : an introduction with applications (6-шы басылым). Берлин: Шпрингер. ISBN 3540047581. OCLC 52203046.

- ^ а б Søren Asmussen (15 May 2003). Applied Probability and Queues. Springer Science & Business Media. б. 7. ISBN 978-0-387-00211-8. Мұрағатталды from the original on 23 March 2017.

- ^ Emanuel Parzen (17 June 2015). Stochastic Processes. Courier Dover жарияланымдары. б. 188. ISBN 978-0-486-79688-8. Мұрағатталды from the original on 20 November 2017.

- ^ Samuel Karlin; Howard E. Taylor (2 December 2012). A First Course in Stochastic Processes. Академиялық баспасөз. pp. 29 and 30. ISBN 978-0-08-057041-9. Мұрағатталды from the original on 23 March 2017.

- ^ John Lamperti (1977). Stochastic processes: a survey of the mathematical theory. Шпрингер-Верлаг. pp. 106–121. ISBN 978-3-540-90275-1. Мұрағатталды from the original on 2017-03-23.

- ^ Sheldon M. Ross (1996). Стохастикалық процестер. Вили. pp. 174 and 231. ISBN 978-0-471-12062-9. Мұрағатталды from the original on 2017-03-23.

- ^ Everitt, B.S. (2002) The Cambridge Dictionary of Statistics. CUP. ISBN 0-521-81099-X

- ^ Parzen, E. (1962) Stochastic Processes, Holden-Day. ISBN 0-8162-6664-6 (Table 6.1)

- ^ Dodge, Y. (2003) The Oxford Dictionary of Statistical Terms, OUP. ISBN 0-19-920613-9 (entry for "Markov chain")

- ^ Dodge, Y. The Oxford Dictionary of Statistical Terms, OUP. ISBN 0-19-920613-9

- ^ Meyn, S. Sean P., and Richard L. Tweedie. (2009) Markov chains and stochastic stability. Кембридж университетінің баспасы. (Preface, p. iii)

- ^ а б c Gagniuc, Paul A. (2017). Markov Chains: From Theory to Implementation and Experimentation. USA, NJ: John Wiley & Sons. pp. 159–163. ISBN 978-1-119-38755-8.

- ^ Gagniuc, Paul A. (2017). Markov Chains: From Theory to Implementation and Experimentation. USA, NJ: John Wiley & Sons. 2-8 бет. ISBN 978-1-119-38755-8.

- ^ а б c г. e Charles Miller Grinstead; James Laurie Snell (1997). Introduction to Probability. Американдық математикалық со. бет.464 –466. ISBN 978-0-8218-0749-1.

- ^ а б c Pierre Bremaud (9 March 2013). Markov Chains: Gibbs Fields, Monte Carlo Simulation, and Queues. Springer Science & Business Media. б. ix. ISBN 978-1-4757-3124-8. Мұрағатталды from the original on 23 March 2017.

- ^ а б c Hayes, Brian (2013). "First links in the Markov chain". Американдық ғалым. 101 (2): 92–96. дои:10.1511/2013.101.92.

- ^ а б Sheldon M. Ross (1996). Стохастикалық процестер. Вили. pp. 235 and 358. ISBN 978-0-471-12062-9. Мұрағатталды from the original on 2017-03-23.

- ^ Jarrow, Robert; Protter, Philip (2004). "A short history of stochastic integration and mathematical finance: The early years, 1880–1970". A Festschrift for Herman Rubin. Institute of Mathematical Statistics Lecture Notes – Monograph Series. 75-91 бет. CiteSeerX 10.1.1.114.632. дои:10.1214/lnms/1196285381. ISBN 978-0-940600-61-4. ISSN 0749-2170.

- ^ Guttorp, Peter; Thorarinsdottir, Thordis L. (2012). "What Happened to Discrete Chaos, the Quenouille Process, and the Sharp Markov Property? Some History of Stochastic Point Processes". Халықаралық статистикалық шолу. 80 (2): 253–268. дои:10.1111/j.1751-5823.2012.00181.x. ISSN 0306-7734.

- ^ Seneta, E. (1996). "Markov and the Birth of Chain Dependence Theory". International Statistical Review / Revue Internationale de Statistique. 64 (3): 255–257. дои:10.2307/1403785. ISSN 0306-7734. JSTOR 1403785.

- ^ Seneta, E. (1998). "I.J. Bienaymé [1796–1878]: Criticality, Inequality, and Internationalization". International Statistical Review / Revue Internationale de Statistique. 66 (3): 291–292. дои:10.2307/1403518. ISSN 0306-7734. JSTOR 1403518.

- ^ Bru B, Hertz S (2001). "Maurice Fréchet". In Heyde CC, Seneta E, Crépel P, Fienberg SE, Gani J (eds.). Ғасырлар статистиктері. Нью-Йорк, Нью-Йорк: Спрингер. 331–334 бет. дои:10.1007/978-1-4613-0179-0_71. ISBN 978-0-387-95283-3.

- ^ а б c Kendall, D. G.; Batchelor, G. K.; Bingham, N. H.; Hayman, W. K.; Hyland, J. M. E.; Lorentz, G. G.; Moffatt, H. K.; Parry, W.; Razborov, A. A.; Robinson, C. A.; Whittle, P. (1990). "Andrei Nikolaevich Kolmogorov (1903–1987)". Лондон математикалық қоғамының хабаршысы. 22 (1): 33. дои:10.1112/blms/22.1.31. ISSN 0024-6093.

- ^ а б Cramer, Harald (1976). "Half a Century with Probability Theory: Some Personal Recollections". Ықтималдық шежіресі. 4 (4): 509–546. дои:10.1214/aop/1176996025. ISSN 0091-1798.

- ^ Marc Barbut; Bernard Locker; Laurent Mazliak (23 August 2016). Paul Lévy and Maurice Fréchet: 50 Years of Correspondence in 107 Letters. Springer London. б. 5. ISBN 978-1-4471-7262-8. Мұрағатталды from the original on 23 March 2017.

- ^ Valeriy Skorokhod (5 December 2005). Basic Principles and Applications of Probability Theory. Springer Science & Business Media. б. 146. ISBN 978-3-540-26312-8. Мұрағатталды from the original on 23 March 2017.

- ^ Bernstein, Jeremy (2005). "Bachelier". Американдық физика журналы. 73 (5): 395–398. Бибкод:2005AmJPh..73..395B. дои:10.1119/1.1848117. ISSN 0002-9505.

- ^ William J. Anderson (6 December 2012). Continuous-Time Markov Chains: An Applications-Oriented Approach. Springer Science & Business Media. б. vii. ISBN 978-1-4612-3038-0. Мұрағатталды from the original on 23 March 2017.

- ^ Kendall, D. G.; Batchelor, G. K.; Bingham, N. H.; Hayman, W. K.; Hyland, J. M. E.; Lorentz, G. G.; Moffatt, H. K.; Parry, W.; Razborov, A. A.; Robinson, C. A.; Whittle, P. (1990). "Andrei Nikolaevich Kolmogorov (1903–1987)". Лондон математикалық қоғамының хабаршысы. 22 (1): 57. дои:10.1112/blms/22.1.31. ISSN 0024-6093.

- ^ а б Ionut Florescu (7 November 2014). Probability and Stochastic Processes. Джон Вили және ұлдары. pp. 373 and 374. ISBN 978-1-118-59320-2. Мұрағатталды from the original on 23 March 2017.

- ^ а б Samuel Karlin; Howard E. Taylor (2 December 2012). A First Course in Stochastic Processes. Академиялық баспасөз. б. 49. ISBN 978-0-08-057041-9. Мұрағатталды from the original on 23 March 2017.

- ^ Gagniuc, Paul A. (2017). Markov Chains: From Theory to Implementation and Experimentation. USA, NJ: John Wiley & Sons. 1-2 беттер. ISBN 978-1-119-38755-8.

- ^ Weiss, George H. (2006). "Random Walks". Encyclopedia of Statistical Sciences. б. 1. дои:10.1002/0471667196.ess2180.pub2. ISBN 978-0471667193.

- ^ Michael F. Shlesinger (1985). The Wonderful world of stochastics: a tribute to Elliott W. Montroll. Солтүстік-Голландия. 8-10 бет. ISBN 978-0-444-86937-1. Мұрағатталды from the original on 2017-03-23.

- ^ Emanuel Parzen (17 June 2015). Stochastic Processes. Courier Dover жарияланымдары. б. 7 and 8. ISBN 978-0-486-79688-8. Мұрағатталды from the original on 20 November 2017.

- ^ Joseph L. Doob (1990). Stochastipoic processes. Вили. б. 46 and 47. Мұрағатталды from the original on 2017-11-20.

- ^ Donald L. Snyder; Michael I. Miller (6 December 2012). Уақыт пен кеңістіктегі кездейсоқ нүктелік процестер. Springer Science & Business Media. б. 32. ISBN 978-1-4612-3166-0. Мұрағатталды from the original on 20 November 2017.

- ^ Norris, J. R. (1997). "Continuous-time Markov chains I". Markov Chains. pp. 60–107. дои:10.1017/CBO9780511810633.004. ISBN 9780511810633.

- ^ а б Serfozo, Richard (2009). "Basics of Applied Stochastic Processes". Probability and Its Applications. дои:10.1007/978-3-540-89332-5. ISBN 978-3-540-89331-8. ISSN 1431-7028.

- ^ "Chapter 11 "Markov Chains"" (PDF). Мұрағатталды (PDF) from the original on 2017-02-15. Алынған 2017-06-02.

- ^ Schmitt, Florian; Rothlauf, Franz (2001). "On the Importance of the Second Largest Eigenvalue on the Convergence Rate of Genetic Algorithms". Proceedings of the 14th Symposium on Reliable Distributed Systems. CiteSeerX 10.1.1.28.6191.

- ^ Franzke, Brandon; Kosko, Bart (1 October 2011). "Noise can speed convergence in Markov chains". Физикалық шолу E. 84 (4): 041112. Бибкод:2011PhRvE..84d1112F. дои:10.1103/PhysRevE.84.041112. PMID 22181092.

- ^ Spitzer, Frank (1970). "Interaction of Markov Processes". Математикадағы жетістіктер. 5 (2): 246–290. дои:10.1016/0001-8708(70)90034-4.

- ^ R. L. Dobrushin; V. I. Kri︠u︡kov; A. L. Toom (1978). Stochastic Cellular Systems: Ergodicity, Memory, Morphogenesis. ISBN 9780719022067. Мұрағатталды түпнұсқасынан 2017-02-05. Алынған 2016-03-04.

- ^ Doblinger, G. (September 1998). "Smoothing of noisy AR signals using an adaptive Kalman filter" (PDF). 9th European Signal Processing Conference (EUSIPCO 1998): 781–784.

- ^ Norris, J. R. (1997). «Үздіксіз Марков тізбектері II». Марков тізбектері. 108–127 беттер. дои:10.1017 / CBO9780511810633.005. ISBN 9780511810633.

- ^ а б c Мэтью Никол және Карл Петерсен, (2009) «Эргодикалық теория: негізгі мысалдар және конструкциялар ",Күрделілік және жүйелік ғылым энциклопедиясы, Springer https://doi.org/10.1007/978-0-387-30440-3_177

- ^ Фицпатрик, Ричард. «Термодинамика және статистикалық механика» (PDF). Мұрағатталды (PDF) түпнұсқасынан 2016-11-30. Алынған 2017-06-02.

- ^ а б ван Равенцвайдж, Дон; Кэсси, Пит; Браун, Скотт Д. (2016-03-11). «Марков тізбегіне қарапайым кіріспе Монте-Карло сынамалары». Психономдық бюллетень және шолу. 25 (1): 143–154. дои:10.3758 / s13423-016-1015-8. ISSN 1069-9384. PMC 5862921. PMID 26968853.

- ^ Райдер, Льюис Х. (1985). Өрістің кванттық теориясы. Кембридж [Cambridgeshire]: Кембридж университетінің баспасы. бет.160. ISBN 978-0521338592. OCLC 10533049.

- ^ Гэттрингер, Христоф; Lang, Christian B (2010). Тордағы кванттық хромодинамика. Физикадан дәрістер. 788. Springer-Verlag Берлин Гейдельберг. дои:10.1007/978-3-642-01850-3. ISBN 978-3-642-01849-7. Мұрағатталды түпнұсқасынан 2017-08-01.

- ^ Андерсон, Дэвид Ф .; Курц, Томас Г. (2011), «Химиялық реакция желілері үшін Марков тізбегінің үздіксіз моделі», Биомолекулалық тізбектерді жобалау және талдау, Springer Нью-Йорк, 3–42 бет, дои:10.1007/978-1-4419-6766-4_1, ISBN 9781441967657

- ^ Ду, Чао; Коу, С.С. (қыркүйек 2012). «Жалғыз ақуыз молекуласының ферментативті реакциясының корреляциялық талдауы». Қолданбалы статистиканың жылнамасы. 6 (3): 950–976. arXiv:1209.6210. Бибкод:2012arXiv1209.6210D. дои:10.1214 / 12-аоас541. ISSN 1932-6157. PMC 3568780. PMID 23408514.

- ^ Кутчукиан, Петр; Лу, Дэвид; Шахнович, Евгений (2009). «Тұман: есірткіге ұқсас химикатты иемденетін де-Ново буынының молекулаларының өсуінің оңтайландырылған алгоритмі». Химиялық ақпарат және модельдеу журналы. 49 (7): 1630–1642. дои:10.1021 / ci9000458. PMID 19527020.

- ^ Кутчукиан, Питер С .; Лу, Дэвид; Шахнович, Евгений И. (2009-06-15). «Тұман: есірткіге ұқсас химиялық кеңістікті алатын молекулалардың де-Ново генерациясының үзінділерінің оңтайлы өсу алгоритмі». Химиялық ақпарат және модельдеу журналы. 49 (7): 1630–1642. дои:10.1021 / ci9000458. ISSN 1549-9596. PMID 19527020.

- ^ Копп, В.С .; Каганер, В.М .; Шварцкопф, Дж .; Уэйдик, Ф .; Реммеле, Т .; Квасневский, А .; Шмидбауэр, М. (2011). «Периодты емес қабатты құрылымдардан корреляциясы бар рентгендік дифракция: Ауривиллийдің аралас пленкаларындағы аналитикалық есептеу және тәжірибе». Acta Crystallographica бөлімі. 68 (Pt 1): 148–155. Бибкод:2012AcCrA..68..148K. дои:10.1107 / S0108767311044874. PMID 22186291.

- ^ Джордж, Дилип; Хокинс, Джефф (2009). Фристон, Карл Дж. (Ред.) «Кортикальды микросұлбалардың математикалық теориясына». PLOS Comput Biol. 5 (10): e1000532. Бибкод:2009PLSCB ... 5E0532G. дои:10.1371 / journal.pcbi.1000532. PMC 2749218. PMID 19816557.

- ^ Гупта, Анкур; Ролингс, Джеймс Б. (сәуір 2014). «Стохастикалық химиялық кинетикалық модельдердегі параметрлерді бағалау әдістерін салыстыру: биологиялық жүйелердегі мысалдар». AIChE журналы. 60 (4): 1253–1268. дои:10.1002 / aic.14409. PMC 4946376. PMID 27429455.

- ^ Агуиар, Р. Дж .; Колларес-Перейра, М .; Conde, J. P. (1988). «Марковтың өтпелі матрицаларының кітапханасын қолдана отырып, тәуліктік сәулелену шамаларының тізбегін құрудың қарапайым процедурасы». Күн энергиясы. 40 (3): 269–279. Бибкод:1988SoEn ... 40..269A. дои:10.1016 / 0038-092X (88) 90049-7.

- ^ Нгоко, Б.О .; Сугихара, Х .; Фунаки, Т. (2014). «Марков модельдерін қолдана отырып, күн сәулесінің жоғары уақыттық шешімділігі синтетикалық генерациясы». Күн энергиясы. 103: 160–170. Бибкод:2014SoEn..103..160N. дои:10.1016 / j.solener.2014.02.026.

- ^ Брайт, Дж. М .; Смит, C. Мен .; Тейлор, П.Г.; Crook, R. (2015). «Ауа-райын бақылаудың орташа сағаттық деректерінен алынған синтетикалық минуттық сәулеленудің уақыттық қатарының стохастикалық генерациясы». Күн энергиясы. 115: 229–242. Бибкод:2015SoEn..115..229B. дои:10.1016 / j.solener.2015.02.032.

- ^ Мунхаммар, Дж .; Widén, J. (2018). «Марков тізбегіндегі ашық күйдегі қоспаның таралу моделі». Күн энергиясы. 173: 487–495. Бибкод:2018SoEn..173..487M. дои:10.1016 / j.solener.2018.07.056.

- ^ Морф, Х. (1998). «Стохастикалық екі күйдегі күн сәулесінің моделі (STSIM)». Күн энергиясы. 62 (2): 101–112. Бибкод:1998SoEn ... 62..101M. дои:10.1016 / S0038-092X (98) 00004-8.

- ^ Мунхаммар, Дж .; Widén, J. (2018). «Марков тізбегіндегі ықтималдықтарды бөлу әдісі ашық аспан индексіне жақындау». Күн энергиясы. 170: 174–183. Бибкод:2018SoEn..170..174M. дои:10.1016 / j.solener.2018.05.055.

- ^ Пратас, D; Силва, Р; Пино, А; Ferreira, P (18 мамыр, 2015). «ДНҚ тізбектерінің жұптары арасындағы қайта құрылымдарды іздеу және бейнелеу үшін туралау әдісі». Ғылыми баяндамалар. 5 (10203): 10203. Бибкод:2015 НатСР ... 510203P. дои:10.1038 / srep10203. PMC 4434998. PMID 25984837.

- ^ О'Коннор, Джон Дж.; Робертсон, Эдмунд Ф., «Марков тізбегі», MacTutor Математика тарихы мұрағаты, Сент-Эндрюс университеті.

- ^ S. P. Meyn, 2007 ж. Күрделі желілерді басқару әдістері Мұрағатталды 2015-05-13 Wayback Machine, Кембридж университетінің баспасы, 2007 ж.

- ^ АҚШ патенті 6 285 999

- ^ Гупта, Бриж; Агравал, Дхарма П .; Ямагучи, Шинго (16 мамыр 2016). Компьютерлік және киберқауіпсіздікке арналған заманауи криптографиялық шешімдерді зерттеу бойынша нұсқаулық. IGI Global. 448– бет. ISBN 978-1-5225-0106-0. Мұрағатталды түпнұсқадан 2017 жылғы 23 наурызда.

- ^ Лангвилл, Эми Н .; Мейер, Карл Д. (2006). «PageRank проблемасын қайта құру» (PDF). SIAM Journal on Scientific Computing. 27 (6): 2112–2113. CiteSeerX 10.1.1.58.8652. дои:10.1137/040607551. ISSN 1064-8275. Мұрағатталды (PDF) түпнұсқасынан 2017-09-21.

- ^ Парақ, Лоуренс; Брин, Сергей; Мотвани, Раджеев; Виноград, Терри (1999). PageRank сілтемелерінің рейтингі: Интернетте тапсырыс беру (Техникалық есеп). CiteSeerX 10.1.1.31.1768.

- ^ Прасад, NR; RC Ender; ST Reilly; G Nesgos (1974). «Минималды шығындар негізінде ресурстарды бөлу». 1974 IEEE шешім мен бақылау бойынша конференциясы, соның ішінде бейімделетін процестерге арналған 13-ші симпозиум. 13: 402–3. дои:10.1109 / CDC.1974.270470.

- ^ Гамильтон, Джеймс (1989). «Стационарлық емес уақыт қатарлары мен іскери циклды экономикалық талдауға жаңа көзқарас». Эконометрика. 57 (2): 357–84. CiteSeerX 10.1.1.397.3582. дои:10.2307/1912559. JSTOR 1912559.

- ^ Кальвет, Лоран Е .; Фишер, Адлай Дж. (2001). «Мультифрактивті құбылмалылықты болжау». Эконометрика журналы. 105 (1): 27–58. дои:10.1016 / S0304-4076 (01) 00069-0. S2CID 119394176.

- ^ Кальвет, Лоран; Адлай Фишер (2004). «Ұзақ мерзімді құбылмалылықты қалай болжау керек: режимді ауыстыру және көпфрактальды процестерді бағалау». Қаржылық эконометрика журналы. 2: 49–83. CiteSeerX 10.1.1.536.8334. дои:10.1093 / jjfinec / nbh003. S2CID 6020401.

- ^ Бреннан, Майкл; Сяб, Иихон. «Акциялар бағасының тұрақсыздығы және меншікті капитал» (PDF). Қаржы бөлімі, Андерсон менеджмент мектебі, UCLA. Архивтелген түпнұсқа (PDF) 2008-12-28.

- ^ «Несиелік тәуекелді модельдеудегі Марков тізбегінің мысалы Колумбия университеті» (PDF). Архивтелген түпнұсқа (PDF) 2016 жылғы 24 наурызда.

- ^ Ацемоглу, Дарон; Георгий Егоров; Константин Сонин (2011). «Әлеуметтік эволюцияның саяси моделі». Ұлттық ғылым академиясының материалдары. 108: 21292–21296. Бибкод:2011PNAS..10821292A. CiteSeerX 10.1.1.225.6090. дои:10.1073 / pnas.1019454108. PMC 3271566. PMID 22198760. Архивтелген түпнұсқа 2013-04-15.

- ^ K McAlpine; Е Миранда; Хоггар (1999). «Алгоритмдермен музыка жасау: жағдайды зерттеу жүйесі». Компьютерлік музыка журналы. 23 (2): 19–30. дои:10.1162/014892699559733. S2CID 40057162.

- ^ Кертис жолдары (ред.) (1996). Компьютерлік музыка бойынша оқулық. MIT түймесін басыңыз. ISBN 978-0-262-18158-7.CS1 maint: қосымша мәтін: авторлар тізімі (сілтеме)

- ^ Ксенакис, Яннис; Канач, Шарон (1992) Ресми музыка: математика және композициядағы ой, Pendragon Press. ISBN 1576470792

- ^ «Жалғастырушы». Архивтелген түпнұсқа 2012 жылғы 13 шілдеде.

- ^ Пакет, Ф .; Рой, П .; Барбиери, Г. (2011) «Шектеулері бар соңғы ұзындықтағы Марков процестері» Мұрағатталды 2012-04-14 сағ Wayback Machine, Жасанды интеллект бойынша 22-ші Халықаралық бірлескен конференция материалдары, IJCAI, 635–642 беттер, Барселона, Испания, 2011 ж. Шілде

- ^ Панкин, Марк Д. «МАРКОВТЫҢ ТИГІС ҮЛГІЛЕРІ: ТЕОРИЯЛЫҚ ЕСЕП». Архивтелген түпнұсқа 2007-12-09 ж. Алынған 2007-11-26.

- ^ Панкин, Марк Д. «МАРКОВТЫҚ ТИГІС БЕЙБОЛ». Мұрағатталды түпнұсқасынан 2009-05-13 ж. Алынған 2009-04-24.

- ^ «Ақындар бұрышы - Фирелинг». Архивтелген түпнұсқа 6 желтоқсан 2010 ж.

- ^ Кеннер, Хью; О'Рурк, Джозеф (Қараша 1984). «Микробтарға арналған травести генераторы». БАЙТ. 9 (12): 129–131, 449–469.

- ^ Хартман, Чарльз (1996). Виртуалды муза: компьютерлік поэзиядағы эксперименттер. Ганновер, NH: Уэслиан Университетінің Баспасы. ISBN 978-0-8195-2239-9.

- ^ а б de Souza e Silva, E.G .; Леги, Л.Ф.Л .; де Соуза Силва, Е.А. (2010). «Толқындар мен жасырын Марков модельдерін қолдана отырып, мұнай бағасының тенденциясын болжау». Энергетикалық экономика. 32.

- ^ а б Карпинон, А; Джорджио, М; Лангелла, Р .; Testa, A. (2015). «Марков тізбегін модельдеу өте қысқа мерзімді жел қуатын болжау». Электр энергетикалық жүйелерін зерттеу. 122: 152–158. дои:10.1016 / j.epsr.2014.12.025.

- ^ а б Мунхаммар, Дж .; ван дер Меер, Дв .; Widén, J. (2019). «Марков тізбегіндегі қоспаны үлестіру моделін қолдана отырып, жоғары ажыратымдылықтағы ашық аспан индексінің уақыттық қатарларын ықтимал болжау». Күн энергиясы. 184: 688–695. Бибкод:2019SoEn..184..688M. дои:10.1016 / j.solener.2019.04.014.

Әдебиеттер тізімі

- Марков А. (1906) «Распространение закона больших чисель на величины, зависящие препарат от друга». Izvestiya Fiziko-matematicheskogo obschestva pri Kazanskom universitete, 2-я серия, том 15, 135-156 бб.

- Марков А. (1971). «Ықтималдықтар теориясының шекті теоремаларын тізбекке қосылған айнымалылардың қосындысына дейін кеңейту». В қосымшасында қайта басылған: Р. Ховард. Динамикалық ықтималдық жүйелер, 1 том: Марков тізбектері. Джон Вили және ұлдары.

- Аудармадағы классикалық мәтін: Марков, А.А. (2006). Аударған Линк, Дэвид. «Евгений Онегин мәтінін статистикалық зерттеуге мысалдардың тізбектерге қосылуына қатысты мысалы». Ғылым контекстте. 19 (4): 591–600. дои:10.1017 / s0269889706001074. S2CID 144854176.

- Лео Брейман (1992) [1968] Ықтималдық. Аддисон-Уэсли шығарған түпнұсқа басылым; қайта басылған Өнеркәсіптік және қолданбалы математика қоғамы ISBN 0-89871-296-3. (7-тарауды қараңыз)

- J. L. Doob (1953) Стохастикалық процестер. Нью-Йорк: Джон Вили және ұлдары ISBN 0-471-52369-0.

- С. П. Мейн және Р. Л. Твиди (1993) Марков тізбектері және стохастикалық тұрақтылық. Лондон: Спрингер-Верлаг ISBN 0-387-19832-6. желіде: MCSS . Екінші басылым пайда болды, Cambridge University Press, 2009 ж.

- S. P. Meyn. Күрделі желілерді басқару әдістері. Кембридж университетінің баспасы, 2007 ж. ISBN 978-0-521-88441-9. Қосымшада қысқартылған Meyn & Tweedie бар. желіде: [1]

- Бут, Тейлор Л. (1967). Тізбектелген машиналар және автоматтар теориясы (1-ші басылым). Нью-Йорк, Нью-Йорк: Джон Вили және ұлдары, Инк. Конгресс кітапханасының каталог нөмірі 67-25924. ] Теориялық информатиктерге де, электр инженерлеріне де арналған мамандарға арналған кең, ауқымды кітап. Күйді минимизациялау техникасы, FSM, Тьюринг машиналары, Марков процестері және шешілмегендігі туралы толық түсіндірмелермен. Марков процестерін керемет емдеу 449ff бет. Z-түрлендірулерді, D-түрлендірулерді олардың контекстінде талқылайды.

- Кемени, Джон Г. Хазлтон Миркил; Дж. Лори Снелл; Томпсон Джеральд (1959). Соңғы математикалық құрылымдар (1-ші басылым). Englewood Cliffs, NJ: Prentice-Hall, Inc. Конгресс кітапханасының карточкасының каталогы 59-12841. Классикалық мәтін. cf 6-тарау Соңғы Марков тізбектері 384ff бет.

- Джон Г. & Дж. Лори Снелл (1960) Соңғы Марков тізбектері, D. van Nostrand компаниясы ISBN 0-442-04328-7

- Э. Нуммелин. «Марковтың жалпы төмендетілмейтін тізбектері және теріс емес операторлар». Кембридж университетінің баспасы, 1984, 2004 ж. ISBN 0-521-60494-X

- Сенета, Э. Теріс емес матрицалар және Марков тізбектері. 2-ші айналым ред., 1981, XVI, 288 б., Статистикадағы жұмсақ мұқабалы Springer Series. (Бастапқыда Allen & Unwin Ltd. баспасынан шыққан, Лондон, 1973 ж.) ISBN 978-0-387-29765-1

- Кишор С. Триведи, Сенімділік, кезек күту және информатика қосымшалары бар ықтималдылық және статистика, John Wiley & Sons, Inc Нью-Йорк, 2002 ж. ISBN 0-471-33341-7.

- К.С.Триведи және Р.А.Сахнер, Жиырма екі жаста, т. 36, жоқ. 4, 52-57 б., ACM SIGMETRICS өнімділікті бағалау шолу, 2009 ж.

- Р. А. Сахнер, К. С. Триведи және А. Пулиафито, Компьютерлік жүйелердің өнімділігі мен сенімділігін талдау: SHARPE бағдарламалық пакетін қолданатын мысалға негізделген тәсіл, Kluwer Academic Publishers, 1996. ISBN 0-7923-9650-2.

- Г.Больч, С.Грайнер, Х.де Меер және К.С.Триведи, Кезек желілері және Марков тізбектері, Джон Вили, 2-ші басылым, 2006 ж. ISBN 978-0-7923-9650-5.

Сыртқы сілтемелер

- Марков тізбектерімен таныстыру қосулы YouTube

- «Марков тізбегі», Математика энциклопедиясы, EMS Press, 2001 [1994]

- Компьютерлік модельдеуді түсіну әдістері: Марков тізбегін талдау

- Марков тізбектері тарауы Американдық математикалық қоғамның ықтималдықтар кітабында (PDF)

- Марков тізбектерін көрнекі түрде түсіндіру

- Марков тізбектерінің мағынасы мен мағынасыздығын жасау

- А.А. Марковтың түпнұсқалық мақаласы (1913): Евгений Онегин мәтінін статистикалық зерттеуге мысал тізбектерге қосылуға қатысты мысал (орыс тілінен аударма)

![mathbf {Q} = f ( mathbf {0} _ {n, n}) [f ( mathbf {P} - mathbf {I} _ {n})] ^ {- 1}.](https://wikimedia.org/api/rest_v1/media/math/render/svg/23b90f245a33e8814743118543f81825ce084a5f)

![{ displaystyle M_ {i} = E [T_ {i}] = sum _ {n = 1} ^ { infty} n cdot f_ {ii} ^ {(n)}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/40a59758d6b3e435f8b501e513653d1387277ae1)

![Y (t) = big {X (s): s in [a (t), b (t)] , big }.](https://wikimedia.org/api/rest_v1/media/math/render/svg/09d6e381d59b76a48ff453d6a16129ba7f2fd239)