Терең оқыту - Deep learning

| Серияның бір бөлігі |

| Машиналық оқыту және деректерді өндіру |

|---|

Машина оқыту орындары |

| Серияның бір бөлігі |

| Жасанды интеллект |

|---|

Технология |

Глоссарий |

Терең оқыту (сонымен бірге терең құрылымдық оқыту) кең отбасының бөлігі болып табылады машиналық оқыту негізделген әдістер жасанды нейрондық желілер бірге өкілдік оқыту. Оқыту болуы мүмкін жетекшілік етеді, жартылай бақылаулы немесе бақылаусыз.[1][2][3]

Сияқты терең білім беретін архитектуралар терең нейрондық желілер, терең сенім желілері, қайталанатын жүйке желілері және конволюциялық жүйке желілері қоса өрістерге қолданылды компьютерлік көру, машинаны көру, сөйлеуді тану, табиғи тілді өңдеу, аудионы тану, әлеуметтік желіні сүзу, машиналық аударма, биоинформатика, есірткі дизайны, медициналық кескінді талдау, материалды тексеру және үстел ойыны бағдарламалар, олар адамның сараптамалық нәтижелерімен салыстырылатын және кейбір жағдайларда асып түсетін нәтижелер шығарды.[4][5][6]

Жасанды жүйке желілері (ANNs) ақпаратты өңдеу мен таратылған байланыс түйіндерінен шабыттанды биологиялық жүйелер. СНН биологиялықтан әртүрлі айырмашылықтарға ие ми. Нақтырақ айтқанда, жүйке желілері статикалық және символдық сипатқа ие, ал тірі организмдердің көпшілігінің биологиялық миы динамикалық (пластикалық) және аналогтық болып табылады.[7][8][9]

Терең оқытудағы «терең» сын есімі желіде бірнеше қабаттарды қолданудан туындайды. Ерте жұмыс сызықтық екенін көрсетті перцептрон әмбебап классификатор бола алмайды, содан кейін полиномиялық емес активация функциясы бар, бір жасырын қабаты шектеусіз ені болуы мүмкін. Терең оқыту - бұл шектеулі мөлшердегі қабаттардың шектеусіз мөлшеріне қатысты, практикалық қолдану мен оңтайландырылған жүзеге асыруға мүмкіндік беретін, жұмсақ жағдайда теориялық әмбебаптықты сақтайтын заманауи вариация. Терең оқытуда қабаттардың гетерогенді болуына және биологиялық ақпараттан кеңінен ауытқуына жол беріледі байланысшы модельдер, тиімділік, дайындық және түсінікті болу үшін, қайдан «құрылымдалған» бөлім.

Анықтама

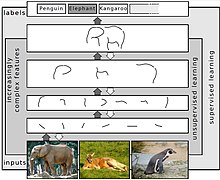

Терең оқыту - бұл сынып машиналық оқыту алгоритмдер бұл[11](pp199–200) бастапқы деңгейден жоғары деңгейлік мүмкіндіктерді біртіндеп алу үшін бірнеше қабаттарды қолданады. Мысалы, in кескінді өңдеу, төменгі қабаттар жиектерді анықтауы мүмкін, ал жоғарғы қабаттар адамға сәйкес ұғымдарды анықтай алады, мысалы цифрлар немесе әріптер немесе беттер.

Шолу

Қазіргі заманғы терең оқыту модельдерінің көпшілігі негізделген жасанды нейрондық желілер, нақты конволюциялық жүйке желілері (CNN), бірақ олар қамтуы мүмкін проекциялық формулалар немесе жасырын айнымалылар терең деңгейде қабатты генеративті модельдер сияқты түйіндер терең сенім желілері және терең Больцман машиналары.[12]

Терең оқытуда әр деңгей өзінің кіріс деректерін сәл абстрактілі және құрама көрініске айналдыруға үйренеді. Суретті тану бағдарламасында шикі кіріс а болуы мүмкін матрица пиксел; бірінші репрезентативті қабат пикселдерді абстракциялауы және шеттерін кодтауы мүмкін; екінші қабат жиектердің орналасуын құрастыруы және кодтауы мүмкін; үшінші қабат мұрын мен көзді кодтауы мүмкін; және төртінші қабат кескіннің бет-бейнесі бар екенін мойындауы мүмкін. Маңыздысы, терең оқу процесі қандай ерекшеліктерді қай деңгейде оңтайлы орналастыру керектігін біле алады өздігінен. (Әрине, бұл қолмен баптау қажеттілігін толығымен жоймайды; мысалы, қабаттардың әр түрлі саны және қабат өлшемдері әр түрлі абстракцияны қамтамасыз ете алады.)[1][13]

«Терең оқыту» кезіндегі «терең» сөзі мәліметтер түрленетін қабаттар санын білдіреді. Дәлірек айтсақ, терең оқыту жүйелері айтарлықтай мәнге ие несие тағайындау жолы (CAP) тереңдігі. CAP - бұл кіріс пен шығысқа дейінгі түрлендірулер тізбегі. CAP-дер кіріс пен шығыс арасындағы ықтимал себеп-салдарлық байланыстарды сипаттайды. Үшін нейрондық желі, CAPs тереңдігі желіге тең және жасырын қабаттардың саны плюс бір болады (өйткені шығыс қабаты да параметрленген). Үшін қайталанатын жүйке желілері, онда сигнал қабат арқылы бірнеше рет таралуы мүмкін, CAP тереңдігі мүмкін шексіз.[2] Тереңдіктің жалпыға бірдей келісілген шегі жоқ, таяз оқытуды терең білімнен бөлмейді, бірақ зерттеушілердің көпшілігі терең оқытуға CAP тереңдігі 2-ден жоғары екеніне келіседі. 2 тереңдігі CAP кез-келген функцияны еліктей алатын мағынасында әмбебап жуықтаушы ретінде көрсетілген. .[14] Бұдан басқа, көп қабаттар желінің функционалды жақындату қабілетіне қосылмайды. Терең модельдер (CAP> 2) таяз модельдерге қарағанда жақсы мүмкіндіктерді шығаруға қабілетті, сондықтан қосымша қабаттар мүмкіндіктерді тиімді үйренуге көмектеседі.

Терең білім беру архитектураларын а ашкөз қабат-қабат әдісі.[15] Терең оқыту осы абстракцияларды ажыратып, өнімділіктің жақсаратын ерекшеліктерін анықтауға көмектеседі.[1]

Үшін бақыланатын оқыту міндеттер, терең оқыту әдістері жойылады инжиниринг, деректерді ұқсас аралық ұсыныстарға аудару арқылы негізгі компоненттер және ұсынуда артықтықты жоятын қабатты құрылымдарды шығарыңыз.

Терең оқыту алгоритмдерін бақылаусыз оқыту тапсырмаларына қолдануға болады. Бұл маңызды артықшылық, себебі таңбаланбаған деректер таңбаланған деректерге қарағанда көбірек. Бақыланбай оқытылатын терең құрылымдардың мысалдары - жүйке тарихындағы компрессорлар[16] және терең сенім желілері.[1][17]

Түсіндірмелер

Бұл бөлім қамтуы мүмкін дәйексөздердің шамадан тыс көптігі. (Маусым 2020) (Бұл шаблон хабарламасын қалай және қашан жою керектігін біліп алыңыз) |

Терең нейрондық желілер әдетте терминдер тұрғысынан түсіндіріледі әмбебап жуықтау теоремасы[18][19][20][21][22] немесе ықтималдық қорытынды.[11][12][1][2][17][23]

Классикалық әмбебап жуықтау теоремасы сыйымдылыққа қатысты нейрондық желілер жуықтау үшін ақырғы өлшемнің бір жасырын қабаты бар үздіксіз функциялар.[18][19][20][21] 1989 жылы алғашқы дәлелді жариялады Джордж Сыбенко үшін сигмоидты белсендіру функциялары[18][дәйексөз қажет ] 1991 жылы Курт Хорник көп қабатты архитектураны жалпылаған.[19] Соңғы жұмыс сонымен қатар әмбебап жуықтаудың түзетілген сызықтық бірлік сияқты шексіз белсендіру функциялары үшін де болатынын көрсетті.[24]

Үшін әмбебап жуықтау теоремасы терең нейрондық желілер ені шектелген, бірақ тереңдігі өсуге мүмкіндік беретін желілердің сыйымдылығына қатысты. Лу және басқалар.[22] егер ені а терең нейрондық желі бірге ReLU активтендіру кіріс өлшемінен едәуір үлкен, содан кейін желі кез-келгенге жуықтай алады Lebesgue интегралданатын функциясы; Егер ені кішірек немесе кіріс өлшеміне тең болса, онда терең нейрондық желі әмбебап жуықтаушы емес.

The ықтималдық түсіндіру[23] өрісінен шығады машиналық оқыту. Онда қорытындылау,[11][12][1][2][17][23] сияқты оңтайландыру тұжырымдамалары оқыту және тестілеу, фитингке байланысты және жалпылау сәйкесінше. Нақтырақ айтсақ, ықтималдық интерпретация активацияны а емес деп санайды жинақталған үлестіру функциясы.[23] Ықтималдық интерпретациясы әкелді түсу сияқты регулятор нейрондық желілерде.[25] Ықтимал түсіндіруді зерттеушілер енгізді, соның ішінде Хопфилд, Жесір және Нарендра сияқты сауалнамаларда танымал болды Епископ.[26]

Тарих

Басқарылатын, терең, қол жетімді, көп қабатты бірінші жалпы, жұмыс оқу алгоритмі перцептрондар жариялады Алексей Ивахненко және Лапа 1967 ж.[27] 1971 жылғы мақалада сегіз қабатты терең желіні суреттеді мәліметтерді өңдеудің топтық әдісі.[28] Басқа терең архитектуралық жұмыс архитектуралары, дәлірек айтсақ компьютерлік көру, деп басталды Неокогнитрон енгізген Кунихико Фукусима 1980 жылы.[29]

Термин Терең оқыту машиналық оқыту қауымдастығымен таныстырылды Рина Дечтер 1986 жылы,[30][16] және дейін жасанды нейрондық желілер Игорь Айзенбергтің және оның әріптестерінің 2000 ж Буль шекті нейрондар.[31][32]

1989 жылы, Янн ЛеКун т.б. стандартты қолданды көшіру кері режимінде болған алгоритм автоматты дифференциация 1970 жылдан бастап,[33][34][35][36] мақсатында терең нейрондық желіге қолмен жазылған почта кодтарын тану пошта арқылы. Алгоритм жұмыс істеген кезде, оқыту 3 күнді қажет етеді.[37]

1991 жылға қарай мұндай жүйелер оқшауланған екі өлшемді цифрларды тану үшін қолданылды, ал 3-өлшемді нысандарды тану 2-өлшемді кескіндерді өз қолымен жасалған 3-D нысан үлгісімен сәйкестендіру арқылы орындалды. Вэн т.б. адамның миы монолитті 3-D нысанды моделін қолданбайды деп ұсынды және 1992 жылы олар Cresceptron жариялады,[38][39][40] беймәлім көріністерде нысанды 3 өлшемді тануды орындау әдісі. Табиғи кескіндерді тікелей қолданғандықтан, Cresceptron табиғи 3D әлеміне арналған жалпыға арналған визуалды оқытудың басталуын бастады. Кресцептрон - неокогнитронға ұқсас қабаттар каскады. Бірақ неокогнитрон адам программистінен функцияларды қолмен біріктіруді талап еткенімен, Кресцептрон әр қабаттағы мүмкіндіктердің ашық санын бақылаусыз үйренді, мұнда әрбір функция функциямен ұсынылады конволюция ядросы. Cresceptron әр үйренілген нысанды желі арқылы кері талдау арқылы сегменттеді. Максималды бассейн, қазір көбінесе терең нейрондық желілер қабылдайды (мысалы. ImageNet Алғаш рет Cresceptron-да позицияны жақсарту үшін каскад арқылы позицияның ажыратымдылығын (2х2) 1-ге төмендету үшін қолданылды.

1994 жылы Андре де Карвальо Майк Фэйрхурст және Дэвид Биссетпен бірге 3 қабатты өзін-өзі ұйымдастыратын жүйеден шығаратын жүйелік модульден тұратын, салмақсыз жүйке желісі деп аталатын көп қабатты бульдік жүйке жүйесінің эксперименттік нәтижелерін жариялады ( SOFT), содан кейін көп қабатты классификация жүйелік модуль (GSN), олар өздігінен оқытылды. Мүмкіндіктерді шығару модуліндегі әр қабат алдыңғы қабатқа қатысты күрделене түсетін мүмкіндіктерді шығарды.[41]

1995 жылы, Брендан Фрей көмегімен екі толық қосылған алты қабатты және бірнеше жүздеген жасырын блоктарды қамтитын желіні (екі күн ішінде) оқытуға болатындығын көрсетті ұйқыдан ояну алгоритмі, бірге дамыған Питер Даян және Хинтон.[42] Баяу жылдамдыққа көптеген факторлар ықпал етеді, соның ішінде жоғалып бара жатқан градиент мәселесі 1991 жылы талданды Сепп Хохрейтер.[43][44]

1997 жылдан бастап, Свен Бехнке жүйке абстракциясы пирамидасында алға бағытталған иерархиялық конволюциялық тәсілді кеңейтті.[45] контекстті шешімдерге икемді түрде енгізу және жергілікті түсініксіздікті итеративті шешу мақсатында жанама және артқа байланыстар арқылы.

Сияқты қолмен жұмыс жасайтын мүмкіндіктерді қолданатын қарапайым модельдер Габор сүзгілері және векторлық машиналар (SVM) 1990 және 2000 жылдары танымал таңдау болды, өйткені жасанды нейрондық желі (ANN) есептеу құны және мидың биологиялық желілерді қалай байланыстыратынын түсінбеу.

ANN-ді таяз және терең оқыту (мысалы, қайталанатын торлар) көптеген жылдар бойы зерттелген.[46][47][48] Бұл әдістер біртекті емес ішкі қолөнер бұйымдары Гаусстан ешқашан асып түспеді қоспаның моделі /Марковтың жасырын моделі (GMM-HMM) дискриминативті түрде оқытылатын сөйлеудің генеративті модельдеріне негізделген технология.[49] Негізгі қиындықтар талданды, оның ішінде градиенттің азаюы[43] және жүйке болжау модельдеріндегі уақытша корреляциялық құрылымның әлсіздігі.[50][51] Қосымша қиындықтар жаттығулар туралы мәліметтердің болмауы және есептеу қуатының шектеулілігі болды.

Көпшілігі сөйлеуді тану зерттеушілер жүйкелік желілерден алшақтап генеративті модельдеуді қолға алды. Ерекше жағдай болды Халықаралық ҒЗИ 1990 жылдардың аяғында. АҚШ үкіметі қаржыландырады NSA және ДАРПА, ҒЗИ сөйлеу мен сөйлеушілерді танудағы терең нейрондық желілерді зерттеді. Басқаратын спикерлерді тану тобы Ларри Хек 1998 жылы сөйлеуді өңдеуде терең нейрондық желілермен айтарлықтай жетістікке жеткендігі туралы хабарлады Ұлттық стандарттар және технологиялар институты Спикерлерді тануды бағалау.[52] Содан кейін SRI терең нейрондық желісі Nuance Verifier-де орналастырылды, бұл терең оқытудың алғашқы ірі өндірістік қолданбасын білдіреді.[53]

Қолдан жасалған оптимизациядан «шикі» ерекшеліктерді жоғарылату принципі 1990 ж. Соңында «шикі» спектрограмма немесе сызықтық фильтр-банк ерекшеліктері бойынша терең аутоинкодер архитектурасында табысты зерттелді,[53] спектрограммалардан тұрақты трансформация кезеңдерін қамтитын Мель-Цепстральдық ерекшеліктерден оның артықшылығын көрсету. Сөйлеудің шикі ерекшеліктері, толқын формалары, кейінірек үлкен ауқымды нәтижелер берді.[54]

Сөйлеуді танудың көптеген аспектілері терең оқыту әдісімен қабылданды ұзақ мерзімді жад (LSTM), қайталанатын жүйке желісі, Hochreiter және Шмидубер 1997 жылы.[55] LSTM RNN-лері жоғалып бара жатқан градиент проблемасынан аулақ болады және «Өте терең оқыту» тапсырмаларын игере алады[2] сөйлеу үшін маңызды мыңдаған дискреттік уақыт кезеңдерінде болған оқиғалар туралы естеліктер қажет. 2003 жылы LSTM дәстүрлі сөйлеу танушылармен белгілі бір міндеттер бойынша бәсекеге қабілетті бола бастады.[56] Кейінірек ол коннектистік уақытша классификациямен (CTC) біріктірілді[57] LSTM RNN стектерінде.[58] 2015 жылы Google-дің сөйлеуін тану CTC-тен оқылған LSTM арқылы 49% -дық әсерлі секірісті бастан кешірді, олар арқылы қол жетімді болды Google дауыстық іздеу.[59]

2006 жылы басылымдар Джеофф Хинтон, Руслан Салахутдинов, Осиндеро және Тех[60][61][62] қаншалықты көп қабатты екенін көрсетті нейрондық желі әр қабатты бақылаусыз ретінде қарастыра отырып, бір уақытта бір қабатты тиімді түрде алдын-ала дайындауға болады шектеулі Больцман машинасы, содан кейін бақыланатын көмегімен оны дәл баптаңыз көшіру.[63] Қағаздарға сілтеме жасалған оқыту үшін терең сенім торлары.

Терең оқыту - бұл әр түрлі пәндердегі заманауи жүйелердің бөлігі, атап айтқанда компьютерлік көру және сөйлеуді автоматты түрде тану (ASR). Сияқты жиі қолданылатын бағалау жиынтығы бойынша нәтижелер УАҚЫТ (ASR) және MNIST (кескін классификациясы ), сонымен қатар сөйлеуді тану бойынша ауқымды лексикалық тапсырмалар ауқымы үнемі жақсарды.[64][65][66] Конволюциялық жүйке желілері (CNN) CTC-ті ASR орнына ауыстырды[57] LSTM үшін.[55][59][67][68][69][70][71] бірақ компьютерлік көруде анағұрлым табысты.

Өндірістегі терең оқытудың әсері 2000-шы жылдардың басында басталды, сол кезде CNN АҚШ-та жазылған барлық тексерулердің шамамен 10% -дан 20% -на дейін өңдеді, дейді Янн ЛеКун.[72] Сөйлеуді кең көлемде тану үшін тереңдетіп оқытуды өндірістік қолдану 2010 жылы басталды.

2009 ж. NIPS сөйлеуді тану үшін терең оқыту бойынша семинар[73] сөйлеудің терең генеративті модельдерінің шектеулері және терең нервтік желілердің (DNN) практикалық бола алатындай қабілетті аппараттық құралдар мен ауқымды мәліметтер жиынтығын беруі мүмкін болды. Терең сенім торларының (DBN) генеративті модельдерін қолдана отырып дайындыққа дейінгі DNN жүйке торларының негізгі қиындықтарын жеңеді деп сенген.[74] Алайда дайындық алдындағы дайындықты тікелей оқытудың үлкен көлеміндегі мәліметтермен алмастыратындығы анықталды көшіру үлкен, контекстке тәуелді шығыс қабаттары бар DNN-ді қолдану кезінде қателіктер жылдамдығы заманауи Гаусс қоспасы моделіне (GMM) / Hidden Markov Model (HMM), сонымен қатар жетілдірілген генеративті модельге негізделген жүйелерге қарағанда күрт төмен болды. .[64][75] Екі типті жүйелер шығарған тану қателіктерінің сипаты ерекше әр түрлі болды,[76][73] барлық негізгі сөйлеуді тану жүйелерінде қолданыстағы жоғары тиімді, сөйлеуді декодтау жүйесіне тереңдетілген оқытуды қалай біріктіру туралы техникалық түсініктер ұсынады.[11][77][78] ГММ-ге (және сөйлеудің басқа генеративті модельдеріне) қарсы DNN модельдеріне қарама-қарсы 2009-2010 жж. Талдау, сөйлеуді тану үшін терең білім алуға ерте өндірістік инвестицияларды ынталандырды,[76][73] сайып келгенде, сол салада кең таралған және басым қолдануға әкеледі. Бұл талдау дискриминациялық DNN және генеративті модельдер арасындағы салыстырмалы өнімділікпен (қателік деңгейі 1,5% -дан аз) жасалды.[64][76][74][79]

2010 жылы зерттеушілер TIMIT-тен контекстке тәуелді HMM күйлеріне негізделген DNN шығарылымының үлкен қабаттарын қабылдау арқылы үлкен сөздік қорды тануға дейін кеңейтті. шешім ағаштары.[80][81][82][77]

Техникалық құрал-жабдықтардағы жетістіктер терең білім алуға деген қызығушылықты арттырды. 2009 жылы, Nvidia терең оқытудың «үлкен жарылысы» деп аталатын оқиғаға қатысты болды, өйткені «терең білім жүйке желілері Nvidia-мен бірге оқытылды графикалық өңдеу қондырғылары (Графикалық процессорлар). ”[83] Сол жылы, Эндрю Нг GPU терең оқыту жүйелерінің жылдамдығын шамамен 100 есеге арттыра алатындығын анықтады.[84] Атап айтқанда, графикалық процессорлар машиналық оқытуға қатысатын матрицалық / векторлық есептеулер үшін өте қолайлы.[85][86][87] Графикалық процессорлар жаттығу алгоритмдерін бұйрықтар бойынша жылдамдатады, жұмыс уақытын апталардан күндерге азайтады.[88][89] Одан әрі тереңдетілген оқыту модельдерін тиімді өңдеу үшін арнайы аппараттық және алгоритмдік оңтайландыруларды қолдануға болады.[90]

Терең оқыту революциясы

2012 жылы Джордж Э. Даль бастаған топ «Мерк молекулалық белсенділігі сынағында» жеңіске жетті, бұл көп функциялы терең нейрондық желілерді пайдаланып биомолекулалық мақсат бір препарат.[91][92] 2014 жылы Хохрейтер тобы қоршаған ортаға арналған химиялық заттардың қоректік заттарға, тұрмыстық өнімдерге және дәрі-дәрмектерге мақсатты емес және уытты әсерін анықтау үшін терең оқытуды қолданды және «Tox21 Data Challenge» жеңіп алды NIH, FDA және NCATS.[93][94][95]

2011 жылдан 2012 жылға дейін кескінді немесе затты танудағы қосымша қосымша әсерлер сезілді көшіру ондаған жылдар бойы болған, ал компьютерлік көзқарас бойынша алға жылжу үшін CNN-ді қосқанда, CNN-ді қосқанда, GPU-дегі CNN-ді жылдам енгізу қажет болды.[85][87][37][96][2] 2011 жылы бұл тәсіл визуалды үлгіні тану байқауында бірінші рет адамнан тыс өнімділікке қол жеткізді. Сондай-ақ, 2011 жылы ICDAR қытай қолжазбалары байқауында жеңімпаз атанды, ал 2012 жылдың мамырында ISBI кескіндерді сегменттеу байқауында жеңіске жетті.[97] 2011 жылға дейін CNN компьютерлік көру конференцияларында маңызды рөл атқарған жоқ, бірақ 2012 жылдың маусымында Ciresan et al. жетекші конференцияда CVPR[4] GPU-дегі ең көп жинақталған CNN көптеген көрнекі көрсеткіштерді қалай жақсартуға болатындығын көрсетті. 2012 жылдың қазанында ұқсас жүйе Крижевский және т.б.[5] ауқымды жеңіп алды ImageNet байқауы таяз машиналық оқыту әдістерінен едәуір айырмашылықпен. 2012 жылдың қараша айында Ciresan және басқалардың жүйесі ICPR байқауында қатерлі ісіктерді анықтауға арналған ірі медициналық кескіндерді талдау конкурсында жеңіске жетті, ал келесі жылы осы тақырып бойынша MICCAI Grand Challenge.[98] 2013 және 2014 жылдары ImageNet тапсырмасындағы қателіктер деңгейі терең оқытуды қолдана отырып, сөйлеуді кең ауқымда тану үрдісіне сәйкес төмендеді. The Вольфрам Кескінді сәйкестендіру жобасы осы жақсартуларды жариялады.[99]

Содан кейін суретті жіктеу анағұрлым күрделі міндетке дейін кеңейтілді сипаттамаларды қалыптастыру көбінесе CNN және LSTM тіркесімдері ретінде суреттерге (жазулар).[100][101][102][103]

Кейбір зерттеушілер 2012 жылғы қазан айындағы ImageNet жеңісі «интеллектуалды индустрияны» өзгерткен «терең оқу революциясының» бастауы болғанын айтады.[104]

2019 жылдың наурызында, Йошуа Бенгио, Джеффри Хинтон және Янн ЛеКун марапатталды Тюринг сыйлығы терең нейрондық желілерді есептеудің маңызды компонентіне айналдырған тұжырымдамалық және инженерлік жетістіктер үшін.

Нейрондық желілер

Жасанды жүйке желілері

Жасанды жүйке желілері (ANNs) немесе байланысшы жүйелер -дан шабыт алған есептеу жүйелері болып табылады биологиялық жүйке желілері жануарлардың миын құрайтын Мұндай жүйелер мысалдарды қарастыру арқылы тапсырмаларды орындауға үйренеді (қабілеттерін біртіндеп жақсартады). Мысалы, кескінді тану кезінде олар мысалдарды қолмен жасалған мысалдарға талдау жасау арқылы анықтауға үйренуі мүмкін белгіленген «мысық» немесе «мысық жоқ» ретінде және басқа кескіндердегі мысықтарды анықтау үшін аналитикалық нәтижелерді қолдану. Олар дәстүрлі компьютерлік алгоритмді қолдану арқылы түсіндіру қиын қосымшаларда көп қолданылды ережеге негізделген бағдарламалау.

ANN деп аталатын жалғанған бірліктер жиынтығына негізделген жасанды нейрондар, (а. биологиялық нейрондарға ұқсас биологиялық ми ). Әрбір байланыс (синапс ) нейрондар арасында басқа нейронға сигнал бере алады. Қабылдаушы (постсинапстық) нейрон сигналдарды (сигналдарды) өңдей алады, содан кейін оған қосылған нейрондардың төменгі жағында сигнал береді. Нейрондардың күйі болуы мүмкін, оларды әдетте бейнелейді нақты сандар, әдетте, 0 мен 1 аралығында. Нейрондар мен синапстардың салмағы оқуға қарай өзгеруі мүмкін, ол төменгі ағысқа жіберетін сигналдың күшін азайтуы немесе төмендетуі мүмкін.

Әдетте, нейрондар қабаттар түрінде ұйымдастырылған. Әр түрлі қабаттар кірістерінде әртүрлі түрлендірулер жүргізе алады. Сигналдар біріншіден (кіріс), соңғы (шығыс) қабатқа өтеді, мүмкін қабаттарды бірнеше рет айналып өткеннен кейін.

Нейрондық желі тәсілінің бастапқы мақсаты мәселелерді адамның миы шешетін әдіспен шешу болды. Уақыт өте келе назар ерекше психикалық қабілеттерді сәйкестендіруге бағытталды, мысалы биологиядан ауытқуларға әкелді көшіру, немесе ақпаратты кері бағытта жіберу және сол ақпаратты көрсету үшін желіні реттеу.

Нейрондық желілер әртүрлі міндеттерде қолданылды, соның ішінде компьютерлік көру, сөйлеуді тану, машиналық аударма, әлеуметтік желі сүзу, үстел және видео ойындарын ойнау және медициналық диагностика.

2017 жылдан бастап жүйке желілері бірнеше мыңнан бірнеше миллионға дейін және миллиондаған байланыстарға ие. Бұл сан адамның миындағы нейрондар санынан бірнеше рет кіші болғанына қарамастан, бұл желілер көптеген тапсырмаларды адамдардан тыс деңгейде орындай алады (мысалы, беттерді тану, «Go» ойыны)[105] ).

Терең жүйке желілері

Бұл бөлім оқырмандардың көпшілігінің түсінуіне тым техникалық болуы мүмкін. өтінемін оны жақсартуға көмектесу дейін оны мамандар емес адамдарға түсінікті етіңіз, техникалық мәліметтерді жоймай. (Шілде 2016) (Бұл шаблон хабарламасын қалай және қашан жою керектігін біліп алыңыз) |

Терең нейрондық желі (DNN) - бұл жасанды нейрондық желі (ANN) кіріс және шығыс қабаттары арасындағы бірнеше қабаттар.[12][2] Нейрондық желілердің әр түрлі типтері бар, бірақ олар әрдайым бірдей компоненттерден тұрады: нейрондар, синапстар, салмақтар, бейімділік және функциялар.[106] Бұл компоненттер адамның миына ұқсас жұмыс істейді және кез-келген ML алгоритмі сияқты оқытылуы мүмкін.[дәйексөз қажет ]

Мысалы, ит тұқымын тануға үйретілген DNN берілген суреттің үстінен өтіп, суреттегі иттің белгілі бір тұқым болу ықтималдығын есептейді. Пайдаланушы нәтижелерді қарап, желінің қандай ықтималдықтарды көрсетуі керектігін таңдай алады (белгілі бір шектен жоғары және т.б.) және ұсынылған белгіні қайтара алады. Әрбір математикалық манипуляция қабат ретінде қарастырылады, ал күрделі DNN көптеген қабаттарға ие, сондықтан «терең» желілер деп аталады.

DNN күрделі сызықтық емес қатынастарды модельдей алады. DNN архитектурасы композициялық модельдер жасайды, мұнда объект қабатты композиция түрінде көрсетіледі примитивтер.[107] Қосымша қабаттар төменгі қабаттардың мүмкіндіктерін құруға мүмкіндік береді, ұқсас деректерді таяз желіге қарағанда азырақ бірліктермен күрделі деректерді модельдейді.[12]

Терең сәулеттер бірнеше негізгі тәсілдердің көптеген нұсқаларын қамтиды. Әр сәулет нақты домендерде сәттілікке қол жеткізді. Бірнеше архитектураның өнімділігін салыстыру әрдайым мүмкін емес, егер олар бірдей мәліметтер жиынтығында бағаланбаса.

DNN-дері - бұл кіріс қабатынан шығыс қабатына кері циклсыз ақпараттар жіберілетін алдыңғы қатарлы желілер. Алдымен DNN виртуалды нейрондардың картасын жасайды және олардың арасындағы байланыстарға кездейсоқ сандық мәндерді немесе «салмақтарды» тағайындайды. Салмақ пен кірістер көбейтіліп, нәтиже 0 мен 1 аралығында шығады, егер желі белгілі бір заңдылықты дәл мойындамаса, алгоритм салмақтарды реттейтін еді.[108] Осылайша, алгоритм белгілі бір параметрлерді әсерлі ете алады, ол деректерді толығымен өңдеу үшін дұрыс математикалық манипуляцияны анықтағанға дейін.

Қайталанатын нейрондық желілер (RNN), онда мәліметтер кез-келген бағытта ағып кетуі мүмкін, мысалы қосымшалар үшін қолданылады тілдік модельдеу.[109][110][111][112][113] Ұзақ мерзімді жады әсіресе осы қолдану үшін тиімді.[55][114]

Конволюциялық терең нейрондық желілер (CNN) компьютерлік көріністе қолданылады.[115] CNN-ге де қатысты акустикалық модельдеу сөйлеуді автоматты түрде тану үшін (ASR).[71]

Қиындықтар

ANN-дегідей, көптеген мәселелер қарапайым оқытылған DNN-де туындауы мүмкін. Екі жалпы мәселе артық киім және есептеу уақыты.

Оқу деректеріндегі сирек тәуелділіктерді модельдеуге мүмкіндік беретін абстракция қабаттарының қосылғандығынан DNN-дің шамасы жоғарылайды. Регуляризация Ивахненконың қондырғысын кесу сияқты әдістер[28] немесе салмақтың ыдырауы (-реттеу) немесе сирек (-регуляризация) шамадан тыс фитингке қарсы жаттығу кезінде қолдануға болады.[116] Баламалы түрде, мектепті тастауды регулизациялау жаттығу кезінде жасырын қабаттардан бірліктерді кездейсоқ шығарады. Бұл сирек тәуелділіктерді болдырмауға көмектеседі.[117] Ақырында, деректерді кесу және айналдыру сияқты әдістермен толықтыруға болады, осылайша шамадан тыс киіну мүмкіндігін азайту үшін кішігірім жаттығулар жиынтығын ұлғайтуға болады.[118]

DNN көптеген жаттығу параметрлерін қарастыруы керек, мысалы, өлшемі (қабаттар саны және қабаттағы бірліктер саны), оқу деңгейі, және бастапқы салмақ. Параметрлер кеңістігі бойынша сыпыру оңтайлы параметрлер үшін уақыт бойынша шығындар мен есептеу ресурстарына байланысты мүмкін болмауы мүмкін. Пакетинг сияқты әртүрлі трюктер (градиентті жеке мысалдарға емес, бірнеше жаттығу мысалдарына бірден есептеу)[119] есептеуді жеделдету. Көп ядролы архитектураларды өңдеудің үлкен мүмкіндіктері (мысалы, графикалық процессорлар немесе Intel Xeon Phi) оқыту кезінде айтарлықтай жылдамдықтар туғызды, өйткені мұндай өңдеу архитектуралары матрицалық және векторлық есептеулерге сәйкес келеді.[120][121]

Сонымен қатар, инженерлер тікелей және конвергентті оқыту алгоритмдерімен жүйке желілерінің басқа түрлерін іздеуі мүмкін. CMAC (церебрелярлық модель артикуляция контроллері ) осындай жүйке торларының бірі болып табылады. Бұл CMAC үшін оқу жылдамдығын немесе кездейсоқ бастапқы салмақты қажет етпейді. Жаттығу процесінің жаңа қадамдармен бір қадамда жинақталуына кепілдік беруге болады, ал жаттығу алгоритмінің есептеу күрделілігі қатысқан нейрондардың санына байланысты сызықтық болып табылады.[122][123]

Жабдық

2010 жылдан бастап машиналық оқыту алгоритміндегі жетістіктер және компьютерлік жабдық сызықтық емес жасырын блоктардың көптеген қабаттарын және өте үлкен шығыс қабатын қамтитын терең нейрондық желілерді оқытудың тиімді әдістеріне әкелді.[124] 2019 жылға қарай графикалық өңдеу қондырғылары (Графикалық процессорлар ), көбінесе АИ-ге арналған жақсартулармен, кең ауқымды коммерциялық бұлтты АИ-ны оқытудың басым әдісі ретінде орталық процессорларды ығыстырды.[125] OpenAI AlexNet-тен (2012 ж.) бастап AlphaZero-ға (2017 ж.) дейінгі тереңдетілген оқытудың ең ірі жобаларында қолданылатын аппаратуралық есептеуді бағалап, 3,4 айдың екі еселенген трендингімен есеп айырысу көлемінің 300 000 есе өсуін анықтады.[126][127]

Қолданбалар

Сөйлеуді автоматты түрде тану

Сөйлеуді автоматты түрде тану - бұл тереңдетіп оқытудың алғашқы және сенімді сәтті жағдайы. LSTM RNNs «Өте терең оқыту» тапсырмаларын оқи алады[2] сөйлеу оқиғаларын қамтитын бірнеше секундтық интервалдарды қамтиды, бұл мыңдаған дискретті уақыт қадамдарымен бөлінген, мұндағы бір қадам шамамен 10 мс сәйкес келеді. Ұмытылған қақпалары бар LSTM[114] белгілі бір міндеттер бойынша дәстүрлі сөйлеу танушылармен бәсекеге қабілетті.[56]

Сөйлеуді танудың алғашқы жетістігі TIMIT негізінде шағын тану тапсырмаларына негізделген. Мәліметтер жиынтығында сегіз негізгі 630 спикер бар диалектілер туралы Американдық ағылшын, мұнда әр сөйлеуші 10 сөйлемнен оқиды.[128] Оның кішкентай өлшемі көптеген конфигурацияларды қолдануға мүмкіндік береді. Бұдан да маңыздысы, TIMIT тапсырмасы телефон тізбегін тануға қатысты, бұл сөз тізбегін танудан айырмашылығы әлсіз телефонға мүмкіндік береді биграм тілдік модельдер. Бұл сөйлеуді танудың акустикалық модельдеу аспектілерінің күшін оңай талдауға мүмкіндік береді. Төменде келтірілген қателіктер, соның ішінде осы алғашқы нәтижелер және телефондық қателіктердің пайыздық коэффициенті (PER) ретінде өлшенетіндер 1991 жылдан бастап қорытындыланды.

| Әдіс | Телефон пайызы қателік деңгейі (PER) (%) |

|---|---|

| Кездейсоқ инициализацияланған RNN[129] | 26.1 |

| Bayesian Triphone GMM-HMM | 25.6 |

| Жасырын траектория (генеративті) моделі | 24.8 |

| Монофон кездейсоқ инициализацияланған DNN | 23.4 |

| Монофон DBN-DNN | 22.4 |

| BMMI оқуы бар Triphone GMM-HMM | 21.7 |

| Fbank-тағы монофон DBN-DNN | 20.7 |

| Конволюциялық DNN[130] | 20.0 |

| Конволюциялық DNN w. Гетерогенді бассейн | 18.7 |

| DNN / CNN / RNN ансамблі[131] | 18.3 |

| Екі бағытты LSTM | 17.8 |

| Иерархиялық конволюциялық Deep Maxout Network[132] | 16.5 |

1990-шы жылдардың аяғында спикерлерді тану және 2009-2011 ж.ж. және 2003-2007 жж. LSTM сөйлеуді тану бойынша дебюті сегіз негізгі бағыт бойынша ілгерілеуді жеделдетті:[11][79][77]

- Масштабтау / шығу және жылдамдатылған DNN жаттығулары мен декодтау

- Дискриминациялық оқытудың кезектілігі

- Негізгі механизмдерді жақсы түсінетін терең модельдермен функцияны өңдеу

- DNN-ді бейімдеу және онымен байланысты терең модельдер

- Көп тапсырма және ауыстырып оқыту DNN және онымен байланысты терең модельдер бойынша

- CNN және оларды ең жақсы пайдалану үшін қалай жобалау керек домендік білім сөйлеу

- RNN және оның бай LSTM нұсқалары

- Терең модельдердің басқа түрлері, соның ішінде тензорға негізделген модельдер және интеграцияланған терең генеративті / дискриминациялық модельдер.

Барлық негізгі коммерциялық сөйлеу тану жүйелері (мысалы, Microsoft) Кортана, Xbox, Skype аудармашысы, Amazon Alexa, Google Now, Apple Siri, Байду және iFlyTek дауыстық іздеу және Нюанс сөйлеу өнімдері және т.б.) терең оқуға негізделген.[11][133][134]

Электромиографияны (ЭМГ) тану

Электромиография (EMG) сигналдары пайдаланушының интеллектуалды мүгедектер арбалары, экзоскелет және протездік құрылғылар сияқты көмекші құрылғыларды басқаруға деген ниетін анықтауда кеңінен қолданылды. Өткен ғасырда алға қарай тығыз нейрондық желі қолданылды. Содан кейін зерттеуші қолданды спектрограмма EMG сигналын картаға түсіріп, содан кейін оны терең конволюциялық нейрондық желілердің кірісі ретінде пайдалану керек. Жақында шикі сигналдарды пайдаланушының ниетін анықтауға тікелей салыстыру үшін ұштық терең оқыту қолданылады.[135]

Кескінді тану

Кескінді жіктеуге арналған жалпы бағалау жиынтығы - бұл MNIST мәліметтер қорының мәліметтер жиынтығы. MNIST қолмен жазылған цифрлардан тұрады және 60,000 оқыту мысалдары мен 10000 тест мысалдарынан тұрады. TIMIT сияқты, оның кішігірім өлшемі пайдаланушыларға бірнеше конфигурацияларды тексеруге мүмкіндік береді. Осы жинақтағы нәтижелердің толық тізімі қол жетімді.[136]

Оқыту негізінде терең бейнені тану адам баласына қарағанда дәлірек нәтиже беретін «адамгершілікке» айналды. Бұл бірінші рет 2011 жылы болған.[137]

Терең оқытудан өткен көліктер қазір 360 ° камераның көрінісін түсіндіреді.[138] Тағы бір мысал - генетикалық синдромдардың үлкен мәліметтер базасына байланысты адамның даму ақауларын талдау үшін қолданылатын бет дисморфологиясының роман анализі (FDNA).

Көркемдік өңдеу

Бейнені танудағы жетістіктермен тығыз байланысты - бұл бейнелеу өнерінің әртүрлі тапсырмаларына тереңдетілген оқыту әдістерін қолдану. ДНН-лер өздерінің қабілеттіліктерін дәлелдеді, мысалы: а) берілген кескіндеменің стиль кезеңін анықтауға, б) Нейрондық стиль трансферті - берілген сурет туындысының стилін түсіру және оны көрнекі түрде фотосуретке немесе бейнеге жағымды түрде қолдану және с) кездейсоқ визуалды енгізу өрістеріне негізделген таңқаларлық кескіндер жасау.[139][140]

Табиғи тілді өңдеу

Нейрондық желілер тілдік модельдерді енгізу үшін 2000 жылдардың басынан бастап қолданыла бастады.[109] LSTM машиналық аударманы және тілдік модельдеуді жақсартуға көмектесті.[110][111][112]

Осы саладағы басқа негізгі әдістер теріс іріктеу болып табылады[141] және сөз енгізу. Сияқты сөз ендіру word2vec, атомдық сөзді деректер жиынтығындағы басқа сөздерге қатысты сөздің позициялық көрінісіне айналдыратын терең оқыту архитектурасындағы өкілдік деңгей деп қарастыруға болады; позиция а нүктесінде көрсетілген векторлық кеңістік. Сөз ендіруді RNN кіріс қабаты ретінде пайдалану желіге тиімді композициялық векторлық грамматиканың көмегімен сөйлемдер мен сөз тіркестерін талдауға мүмкіндік береді. Композициялық векторлық грамматика деп ойлауға болады ықтималдық контекст еркін грамматика (PCFG) RNN жүзеге асырады.[142] Сөздер құрамына салынған рекурсивті автоинкодерлер сөйлемнің ұқсастығын бағалап, парафразалауды анықтай алады.[142] Терең жүйке сәулеттері ең жақсы нәтиже береді сайлау округін талдау,[143] көңіл-күйді талдау,[144] ақпарат іздеу,[145][146] сөйлеу тілін түсіну,[147] машиналық аударма,[110][148] байланыстыратын контексттік нысан,[148] жазу стилін тану,[149] Мәтінді жіктеу және басқалары.[150]

Соңғы оқиғалар жалпыландырады сөз енгізу дейін сөйлемді енгізу.

Google Аудармашы (GT) үлкенді пайдаланады аяғына дейін ұзақ мерзімді жады желісі.[151][152][153][154][155][156] Google Neural Machine Translation (GNMT) қолданады мысалға негізделген машиналық аударма жүйе «миллиондаған мысалдардан сабақ алатын» әдіс.[152] Ол бір уақытта бөліктерді емес, тұтас сөйлемдерді аударады. Google Translate жүзден астам тілді қолдайды.[152] Желі «фразалардан аудармаларды жай жаттаудан гөрі, сөйлемнің семантикасын» кодтайды.[152][157] GT көптеген тілдік жұптардың арасында делдал ретінде ағылшын тілін қолданады.[157]

Дәрілерді табу және токсикология

Дәрі-дәрмектерге кандидаттардың үлкен пайызы заңды мақұлдауды ала алмайды. Бұл сәтсіздіктер тиімділіктің жеткіліксіздігімен (мақсатты әсер), қажетсіз өзара әрекеттесулерден (мақсаттан тыс әсерлер) немесе күтпегендіктен болады уытты әсерлер.[158][159] Зерттеулер терең білімді болжау үшін қолдануды зерттеді биомолекулалық мақсаттар,[91][92] мақсаттан тыс, және уытты әсерлер қоректік заттардағы, тұрмыстық өнімдердегі және дәрілік заттардағы қоршаған ортаға арналған химиялық заттар[93][94][95]

AtomNet - бұл құрылымға негізделген терең оқыту жүйесі дәрі-дәрмектің ұтымды дизайны.[160] AtomNet жаңа ауру кандидаттарының биомолекулаларын болжау үшін қолданылды, мысалы, аурудың нысандары Эбола вирусы[161] және склероз.[162][163]

2019 жылы эксперименталды түрде тышқандарға дейін расталған молекулаларды алу үшін генеративті нейрондық желілер қолданылды.[164][165]

Клиенттермен қарым-қатынас жасау басқармасы

Тереңдете оқыту мүмкін болатын мәнге жуықтау үшін қолданылған тікелей маркетинг тұрғысынан анықталған әрекеттер RFM айнымалылар. Болжалды мән функциясы табиғи түсіндірмесі бар ретінде көрсетілген тұтынушының өмірлік мәні.[166]

Ұсыныс жүйелері

Ұсыныстар жүйелері мазмұнды музыкалық және журналдық ұсыныстарға арналған жасырын факторлық модель үшін маңызды мүмкіндіктерді алу үшін терең оқуды қолданды.[167][168] Бірнеше көріністен тұратын тереңдетілген оқыту көптеген домендерден пайдаланушылардың қалауын үйрену үшін қолданылды.[169] Модель гибридті бірлескен және мазмұнға негізделген тәсілді қолданады және бірнеше тапсырмалар бойынша ұсыныстарды күшейтеді.

Биоинформатика

Ан автоинкодер ANN қолданылды биоинформатика, болжау ген онтологиясы аннотация және ген-функция байланыстары.[170]

Медициналық информатикада терең білім тозуға болатын заттардың деректері негізінде ұйқы сапасын болжау үшін қолданылды[171] және денсаулық жағдайындағы асқынулардың болжамдары электронды денсаулық жазбасы деректер.[172]

Медициналық бейнені талдау

Терең оқыту медициналық қолдануда бәсекеге қабілетті нәтиже береді, мысалы, рак клеткаларын жіктеу, зақымдануды анықтау, ағзаларды сегментациялау және бейнені жақсарту[173][174]

Мобильді жарнама

Сәйкес мобильді аудиторияны табу мобильді жарнама әрдайым қиын, өйткені мақсатты сегмент құрылып, кез-келген жарнама сервері жарнамалық қызмет көрсетуге пайдаланбас бұрын көптеген деректер нүктелерін қарастыру және талдау қажет.[175] Терең оқыту үлкен, көп өлшемді жарнама деректерін түсіндіру үшін қолданылды. Интернеттегі жарнама циклі кезінде көптеген мәліметтер жиналады. Бұл ақпарат жарнаманы таңдауды жақсарту үшін машиналық оқытудың негізі бола алады.

Кескінді қалпына келтіру

Терең оқыту сәтті қолданылды кері мәселелер сияқты denoising, супер ажыратымдылық, түссіздік, және фильмді бояу.[176] Бұл қосымшаларға «суретті тиімді қалпына келтіру үшін кішірейту өрістері» сияқты оқыту әдістері кіреді[177] кескіндер жиынтығына жаттықтыратын және Терең кескін алдындағы қалпына келтіруді қажет ететін кескін бойынша жаттығатын.

Қаржылық алаяқты анықтау

Терең оқыту қаржылық тұрғыдан сәтті қолданылуда алаяқтықты анықтау ақшаны жылыстатуға қарсы іс-қимыл. «Ақшаны жылыстатуға қарсы іс-қимылдың терең жүйесі деректер арасындағы қатынастар мен ұқсастықтарды байқап, тани алады және одан әрі қарай ауытқуларды анықтауға немесе белгілі бір оқиғаларды жіктеуге және болжауға үйренеді». Бұл шешім күдікті операцияларды жіктеу сияқты бақыланатын оқыту әдістерін де, бақылаусыз оқытуды да пайдаланады, мысалы. аномалияны анықтау.[178]

Әскери

Америка Құрама Штаттарының қорғаныс министрлігі роботтарды бақылау арқылы жаңа тапсырмаларға үйрету үшін терең оқытуды қолданды.[179]

Адамның когнитивті және ми дамуымен байланысы

Терең оқыту теориялар класымен тығыз байланысты мидың дамуы (нақтырақ айтсақ, неокортикалық даму) ұсынған когнитивті нейробиологтар 1990 жылдардың басында.[180][181][182][183] Бұл дамудың теориялары есептеу модельдерінде негізделіп, оларды терең оқыту жүйесінің предшественниктеріне айналдырды. Бұл дамытушы модельдер мидағы әртүрлі ұсынылған оқыту динамикасының қасиеттерімен бөліседі (мысалы, толқын жүйке өсу факторы ) қолдау өзін-өзі ұйымдастыру терең оқыту модельдерінде қолданылатын нейрондық желілерге ұқсас. Сияқты неокортекс, нейрондық желілер әр қабатты алдыңғы қабаттан (немесе жұмыс ортасынан) ақпаратты қарастыратын, содан кейін оның шығуын (және мүмкін бастапқы кірісті) басқа қабаттарға жіберетін қатпарлы сүзгілер иерархиясын қолданады. Бұл процесс өзін-өзі ұйымдастыратын стек береді түрлендіргіштер, олардың жұмыс ортасына жақсы реттелген. 1995 жылғы сипаттамада «... нәрестенің миы трофикалық факторлар деп аталатын толқындардың әсерінен өзін-өзі ұйымдастыратын сияқты ... мидың әр түрлі аймақтары дәйекті түрде жалғасады, матаның бір қабаты екіншісіне дейін жетіледі және солай болады бүкіл ми жетілгенге дейін ».[184]

Терең оқыту модельдерінің нейробиологиялық тұрғыдан сенімділігін зерттеу үшін әртүрлі тәсілдер қолданылды. Бір жағынан, бірнеше нұсқалары көшіру алгоритмі оның шынайылығын арттыру мақсатында ұсынылды.[185][186] Басқа зерттеушілер терең басқарудың бақыланбайтын түрлері, мысалы, иерархияға негізделген деп тұжырымдады генеративті модельдер және терең сенім желілері, биологиялық шындыққа жақын болуы мүмкін.[187][188] Осыған байланысты генеративті нейрондық желілер модельдері церебральды қыртыстағы іріктеу негізінде өңдеу туралы нейробиологиялық дәлелдемелермен байланысты болды.[189]

Адамның ми ұйымы мен терең желілердегі нейрондық кодтау арасындағы жүйелі салыстыру әлі орнатылмағанымен, бірнеше ұқсастықтар туралы айтылды. Мысалы, терең оқу бөлімдері орындайтын есептеулер нақты нейрондармен бірдей болуы мүмкін[190][191] және жүйке популяциясы.[192] Сол сияқты, тереңдетілген оқыту модельдері жасаған репрезенциялар приматтардың визуалды жүйесінде өлшенгендерге ұқсас[193] екеуі де бір блокта[194] және халық санына байланысты[195] деңгейлер.

Коммерциялық қызмет

Facebook ИИ зертханасы сияқты тапсырмаларды орындайды жүктелген суреттерді автоматты түрде белгілеу олардың ішіндегі адамдардың есімдері көрсетілген.[196]

Google's DeepMind Technologies ойнауды үйренуге қабілетті жүйе жасады Атари деректерді енгізу ретінде тек пикселдерді қолданатын бейне ойындар. 2015 жылы олар өздерін көрсетті AlphaGo ойынын білген жүйе Барыңыз кәсіби Go ойыншысын жеңуге жеткілікті.[197][198][199] Google Аудармашы 100-ден астам тілге аударма жасау үшін нейрондық желіні қолданады.

2015 жылы, Блиппар ұялы телефонын көрсетті толықтырылған шындық нақты уақыт режимінде объектілерді тану үшін терең оқытуды қолданатын бағдарлама.[200]

2017 жылы терең оқытуды фабрикаларға интеграциялауға бағытталған Covariant.ai іске қосылды.[201]

2008 жылғы жағдай бойынша[202] зерттеушілер Остиндегі Техас университеті (UT) роботтар немесе компьютерлік бағдарламалар үшін адам нұсқаушысымен қарым-қатынас жасау арқылы тапсырмаларды қалай орындау керектігін үйренудің жаңа әдістерін ұсынған «Бағалауды күшейту арқылы қолмен агент оқыту» немесе «TAMER» деп аталатын машиналық оқыту жүйесін жасады.[179] Алдымен TAMER ретінде дамыған Deep TAMER деп аталатын жаңа алгоритм кейінірек 2018 жылы ынтымақтастық кезінде енгізілді АҚШ армиясының зерттеу зертханасы (ARL) және UT зерттеушілері. Deep TAMER роботқа бақылау арқылы жаңа тапсырмаларды игеру мүмкіндігін беру үшін терең оқытуды қолданды.[179] Deep TAMER-ді қолданып, робот адам жаттықтырушысымен бірге тапсырманы үйренді, бейне ағындарын көрді немесе адамның тапсырманы жеке өзі орындауын қадағалады. Кейін робот тапсырманы «жақсы жұмыс» және «нашар жұмыс» сияқты кері байланыс беретін жаттықтырушының кейбір коучингтерінің көмегімен жүзеге асырды.[203]

Сын және түсініктеме

Терең оқыту кейбір жағдайларда информатика аясынан тыс, сын мен пікірлерді де тудырды.

Теория

Негізгі сын кейбір әдістерге байланысты теорияның жоқтығына қатысты.[204] Ең көп таралған терең архитектураларда оқыту градиенттік түсіруді түсіну арқылы жүзеге асырылады. Алайда, басқа алгоритмдерді қоршаған теория, мысалы, контрастты дивергенция онша айқын емес.[дәйексөз қажет ] (мысалы, ол біріктіріле ме? Егер солай болса, қаншалықты жылдам? Ол нені жақындатады?) Терең оқыту әдістері көбінесе қара жәшік, көптеген растаулармен теориялық емес, эмпирикалық түрде жасалады.[205]

Басқалары терең оқытуды жан-жақты шешім ретінде емес, күшті АИ іске асыруға бағытталған қадам ретінде қарау керек деп атап көрсетеді. Терең оқыту әдістерінің күшіне қарамастан, олар осы мақсатты толығымен жүзеге асыруға қажетті көптеген функцияларға ие емес. Зерттеуші психолог Гари Маркус:

«Шынында да, терең білім алу - бұл интеллектуалды машиналарды жасаудың үлкен міндеттерінің бір бөлігі ғана. Мұндай техникада ұсынудың тәсілдері жетіспейді себептік қатынастар (...) орындаудың айқын тәсілдері жоқ логикалық тұжырымдар және олар сонымен қатар абстрактілі білімдерді интеграциялаудан әлі де алыс, мысалы, объектілер деген не, олар не үшін керек және олар қалай пайдаланылатыны туралы ақпарат. Ең қуатты А.И. сияқты жүйелер Уотсон (...) статистикалық техникадан бастап өте күрделі техникалар ансамблінің бір элементі ретінде терең білім алу сияқты әдістерді қолдану Байес қорытындысы дейін дедуктивті ойлау."[206]

Көркемдік сезімталдығы когнитивтік иерархияның салыстырмалы түрде төмен деңгейлеріне енбеуі мүмкін деген ойға қосымша сілтеме жасай отырып, терең (20-30 қабатты) жүйке желілерінің ішкі күйлерінің жарияланған графикалық көріністері кездейсоқ деректер шеңберінде бейнелерді кездейсоқ мәліметтер арқылы анықтауға тырысады. олар оқыды[207] көрнекі тартымдылықты көрсетіңіз: зерттеу туралы алғашқы хабарлама 1000-нан астам түсініктеме алды және бір уақытта ең көп қаралатын мақала болды The Guardian Келіңіздер[208] веб-сайт.

Қателер

Кейбір терең оқыту архитектуралары проблемалық мінез-құлықты көрсетеді,[209] мысалы, танылмайтын кескіндерді қарапайым суреттердің таныс категориясына жататындығына сенімді түрде жіктеу[210] және дұрыс жіктелген суреттердің минусулярлық толқуларын дұрыс емес жіктеу.[211] Герццель бұл мінез-құлық олардың ішкі көріністеріндегі шектеулерге байланысты және бұл шектеулер гетерогенді көп компонентті интеграцияны тежейді деп жорамалдады жасанды жалпы интеллект (AGI) сәулеттері.[209] Бұл мәселелерді имидж-грамматикаға гомологты күйлерді қалыптастыратын терең білім архитектурасы арқылы шешуге болады[212] бақыланатын нысандар мен оқиғалардың ыдырауы.[209] Грамматиканы үйрену (визуалды немесе лингвистикалық) тренинг мәліметтерінен жүйені шектеуге тең болады ортақ пікір ол грамматикалық тұрғыдан ұғымдармен жұмыс істейді өндіріс ережелері және бұл адам тілін меңгерудің негізгі мақсаты[213] және жасанды интеллект (AI).[214]

Киберқауіп

Терең білім зертханадан әлемге қарай жылжып келе жатқанда, зерттеулер мен тәжірибе көрсеткендей, жасанды нейрондық желілер хакерлік пен алдаудың алдында осал.[215] Осы жүйелер жұмыс істейтін үлгілерді анықтау арқылы шабуылдаушылар ANN кірістерін ANN бақылаушылар мойындай алмайтын сәйкестікті тапқандай етіп өзгерте алады. Мысалы, шабуылдаушы кескінге нәзік өзгертулер енгізуі мүмкін, егер ANN іздеу нысаны сияқты адамға көрінбесе де, ANN сәйкес келеді. Мұндай айла-шарғы «қарсылас шабуыл» деп аталады.[216] 2016 жылы зерттеушілер бір ANN-ді кескіндерді сынақтық және қателіктермен өңдеу үшін қолданды, екіншісінің фокустық нүктелерін анықтады және сол арқылы оны алдаған суреттерді жасады. Өзгертілген кескіндер адамның көзіне өзгеше көрінбейтін. Басқа топ суретке түсірілген суреттердің басып шығарылуы кескіндерді жіктеу жүйесін сәтті алдап көрсеткенін көрсетті.[217] Бір қорғаныс - кері суретті іздеу, мысалы жалған сурет сайтқа жіберіледі TinEye содан кейін оның басқа даналарын табуға болады. Нақтылау дегеніміз - кескіннің тек бөліктерін пайдаланып іздеу, сол кескін алынған суреттерді анықтау.[218]

Мұны тағы бір топ көрсетті психоделикалық көзілдірік а бетті тану жүйесі қарапайым адамдардың әйгілі болғанын ойлауға, бір адамға екіншісіне еліктеуге мүмкіндік береді. 2017 жылы зерттеушілер стикерлерді қосты тоқтату белгілері және ANN оларды дұрыс жіктемейді.[217]

Сонымен бірге ANN-ді шабуылдаушылар мен қорғаушыларды қарулану жарысына итермелейтін, алдау әрекеттерін анықтауға үйретуге болады. зиянды бағдарлама қорғаныс өнеркәсібі. ANN-ді қорғаныс жүйесіне үнемі өзгеріп отыратын зиянды бағдарламалармен бірнеше рет шабуыл жасау арқылы ANN-ге негізделген зиянды бағдарламаларға қарсы бағдарламалық жасақтаманы жеңуге үйреткен. генетикалық алгоритм ол мақсатқа зиян келтіру қабілетін сақтай отырып, зиянкестерге қарсы бағдарламаны алдағанша.[217]

Тағы бір топ белгілі бір дыбыстардың шығара алатындығын көрсетті Google Now дауыстық пәрмен жүйесі зиянды бағдарламаны жүктейтін белгілі бір веб-мекен-жайды ашады.[217]

«Деректермен улану» кезінде жалған мәліметтер үнемі машиналық оқыту жүйесінің оқыту жиынтығына өткізіліп, оны игеруге мүмкіндік бермейді.[217]

Адамға арқа сүйеу микро жұмыс

Терең оқыту жүйелерінің көпшілігі адамдар қалыптастыратын және / немесе түсіндірмелер жасайтын оқыту және тексеру мәліметтеріне сүйенеді. Бұл туралы дәлел келтірілді медиа философия бұл тек төмен ақылы емес нұқу (мысалы Amazon механикалық түркі ) осы мақсатта жүйелі түрде қолданылады, сонымен қатар адамның жасырын формалары микро жұмыс олар көбінесе мұндай деп танылмайды.[219] Философ Райнер Мюльхоф жаттығу деректерін қалыптастыру үшін адамның микро жұмысының «механикалық басып алуының» бес түрін ажыратады: (1) геймификация (ойын ағынына аннотация немесе есептеу тапсырмаларын ендіру), (2) «ұстау және қадағалау» (мысалы, CAPTCHAs Google-да кескінді тану немесе кликті қадағалау үшін іздеу нәтижелерінің беттері ), (3) әлеуметтік мотивтерді пайдалану (мысалы: беттерді тегтеу қосулы Facebook бет таңбаланған суреттерді алу үшін), (4) ақпараттық тау-кен (мысалы, пайдалану арқылы сандық-өзіндік сияқты құрылғылар белсенділікті бақылаушылар ) және (5) нұқу.[219] Мұхлхоф «Deep Learning» сияқты соңғы пайдаланушының көптеген коммерциялық қосымшаларында Facebook-тің тұлғаны тану жүйесі, ANN оқытылғаннан кейін оқыту туралы ақпараттың қажеттілігі тоқтамайды. Керісінше, ANN-ді үнемі калибрлеп, жаңартып отыру үшін адам жасаған тексеру деректерінің сұранысы бар. Осы мақсатта Facebook қолданушы суретте автоматты түрде танылғаннан кейін хабарлама алатын функцияны енгізді. Олар суретте көпшілік алдында таңбаланғанды ұнататындығын таңдай алады немесе Facebook-те бұл суретте жоқ екенін айта алады.[220] Бұл қолданушы интерфейсі «тексерудің тұрақты ағыны» құру механизмі болып табылады[219] нақты уақыт режимінде желіні одан әрі оқыту. Мюхлоффтың пікірінше, оқыту мен тексеру деректерін жасау үшін адам пайдаланушыларының қатысуы Deep Learning-тің соңғы пайдаланушыларының коммерциялық қосымшаларының көпшілігіне тән, сондықтан мұндай жүйелер «адамның көмегімен жасанды интеллект» деп аталуы мүмкін.[219]

Сондай-ақ қараңыз

- Жасанды интеллекттің қолданылуы

- Терең оқыту бағдарламалық жасақтамасын салыстыру

- Сығымдалған зондтау

- Echo мемлекеттік желісі

- Жасанды интеллект жобаларының тізімі

- Сұйық күйдегі машина

- Машиналық оқытуға арналған мәліметтер жиынтығы

- Су қоймасын есептеу

- Сирек кодтау

Әдебиеттер тізімі

- ^ а б c г. e f Бенгио, Ю .; Курвилл, А .; Винсент, П. (2013). «Өкілдікті оқыту: шолу және жаңа перспективалар». Үлгіні талдау және машиналық интеллект бойынша IEEE транзакциялары. 35 (8): 1798–1828. arXiv:1206.5538. дои:10.1109 / tpami.2013.50. PMID 23787338. S2CID 393948.

- ^ а б c г. e f ж сағ Шмидубер, Дж. (2015). «Нейрондық желілердегі терең оқыту: шолу». Нейрондық желілер. 61: 85–117. arXiv:1404.7828. дои:10.1016 / j.neunet.2014.09.003. PMID 25462637. S2CID 11715509.

- ^ Бенгио, Йошуа; ЛеКун, Янн; Хинтон, Джеффри (2015). «Терең оқыту». Табиғат. 521 (7553): 436–444. Бибкод:2015 ж. 521..436L. дои:10.1038 / табиғат14539. PMID 26017442. S2CID 3074096.

- ^ а б Киресан, Д .; Мейер, У .; Шмидубер, Дж. (2012). «Кескінді жіктеуге арналған көп бағаналы терең нейрондық желілер». 2012 IEEE конференциясы, компьютерлік көрініс және үлгіні тану. 3642–3649 бет. arXiv:1202.2745. дои:10.1109 / cvpr.2012.6248110. ISBN 978-1-4673-1228-8. S2CID 2161592.

- ^ а б Крижевский, Алекс; Суцкевер, Илья; Хинтон, Джеффри (2012). «Терең конволюциялық жүйке жүйелерімен ImageNet классификациясы» (PDF). NIPS 2012: Нейрондық ақпаратты өңдеу жүйелері, Тахо көлі, Невада.

- ^ «Google-дің AlphaGo AI әлемдегі ең жақсы Go ойыншысына қарсы үш матчта жеңіске жетті». TechCrunch. 25 мамыр 2017 ж.

- ^ Марблстоун, Адам Х .; Уэйн, Грег; Кординг, Конрад П. (2016). «Терең білім мен неврологияны интеграциялау жолында». Есептеу неврологиясындағы шекаралар. 10: 94. arXiv:1606.03813. Бибкод:2016arXiv160603813M. дои:10.3389 / fncom.2016.00094. PMC 5021692. PMID 27683554. S2CID 1994856.

- ^ Олшаузен, Б.А (1996). «Табиғи суреттерге сирек кодты үйрену арқылы қарапайым жасушалық рецептивті өріс қасиеттерінің пайда болуы». Табиғат. 381 (6583): 607–609. Бибкод:1996 ж.381..607O. дои:10.1038 / 381607a0. PMID 8637596. S2CID 4358477.

- ^ Бенгио, Йошуа; Ли, Дон-Хён; Борншейн, Йорг; Мессард, Томас; Линь, Чжухань (2015-02-13). «Биологиялық тұрғыдан ақылға қонымды терең оқуға». arXiv:1502.04156 [cs.LG ].

- ^ Шульц, Ханнес; Бехнке, Свен (2012-11-01). «Терең оқыту». KI - Künstliche Intelligenz. 26 (4): 357–363. дои:10.1007 / s13218-012-0198-з. ISSN 1610-1987. S2CID 220523562.

- ^ а б c г. e f Дэн, Л .; Ю, Д. (2014). «Терең оқыту: әдістері мен қолданылуы» (PDF). Сигналды өңдеу негіздері мен тенденциялары. 7 (3–4): 1–199. дои:10.1561/2000000039.

- ^ а б c г. e Бенгио, Йошуа (2009). «АИ үшін терең архитектураларды үйрену» (PDF). Машиналық оқытудың негіздері мен тенденциялары. 2 (1): 1–127. CiteSeerX 10.1.1.701.9550. дои:10.1561/2200000006. Архивтелген түпнұсқа (PDF) 2016-03-04. Алынған 2015-09-03.

- ^ ЛеКун, Янн; Бенгио, Йошуа; Хинтон, Джеффри (28 мамыр 2015). «Терең оқыту». Табиғат. 521 (7553): 436–444. Бибкод:2015 ж. 521..436L. дои:10.1038 / табиғат14539. PMID 26017442. S2CID 3074096.

- ^ Шигеки, Сугияма (2019-04-12). Адамның мінез-құлқы және сананың тағы бір түрі: дамып келе жатқан зерттеулер мен мүмкіндіктер: дамушы зерттеулер мен мүмкіндіктер. IGI Global. ISBN 978-1-5225-8218-2.

- ^ Бенгио, Йошуа; Ламблин, Паскаль; Попович, Дэн; Ларошель, Гюго (2007). Терең желілерді ашкөздікпен оқыту (PDF). Нейрондық ақпаратты өңдеу жүйесіндегі жетістіктер. 153-160 бб.

- ^ а б Шмидубер, Юрген (2015). «Терең оқыту». Scholarpedia. 10 (11): 32832. Бибкод:2015SchpJ..1032832S. дои:10.4249 / scholarpedia.32832.

- ^ а б c Хинтон, Г.Е. (2009). «Терең сенім желілері». Scholarpedia. 4 (5): 5947. Бибкод:2009SchpJ ... 4.5947H. дои:10.4249 / scholarpedia.5947.

- ^ а б c Цибенко (1989). «Сигмоидты функциялардың суперпозицияларымен жақындасу» (PDF). Басқару, сигналдар және жүйелер математикасы. 2 (4): 303–314. дои:10.1007 / bf02551274. S2CID 3958369. Архивтелген түпнұсқа (PDF) 2015-10-10.

- ^ а б c Хорник, Курт (1991). «Көп қабатты байланыс желілерінің жуықтау мүмкіндіктері». Нейрондық желілер. 4 (2): 251–257. дои:10.1016 / 0893-6080 (91) 90009-т.

- ^ а б Хайкин, Саймон С. (1999). Нейрондық желілер: кешенді қор. Prentice Hall. ISBN 978-0-13-273350-2.

- ^ а б Хассун, Мохамад Х. (1995). Жасанды жүйке желілерінің негіздері. MIT түймесін басыңыз. б. 48. ISBN 978-0-262-08239-6.

- ^ а б Лу, З., Пу, Х., Ванг, Ф., Ху, З., & Ванг, Л. (2017). Нейрондық желілердің экспрессивті күші: енінен көрініс. Нервтік ақпаратты өңдеу жүйелері, 6231-6239.

- ^ а б c г. Мерфи, Кевин П. (24 тамыз 2012). Машиналық оқыту: ықтималдық перспективасы. MIT түймесін басыңыз. ISBN 978-0-262-01802-9.

- ^ Сонода, Шо; Мурата, Нобору (2017). «Белсендірілмеген функциясы бар нейрондық желі - әмбебап жуықтаушы». Қолданбалы және есептеуіш гармоникалық талдау. 43 (2): 233–268. arXiv:1505.03654. дои:10.1016 / j.acha.2015.12.005. S2CID 12149203.

- ^ Хинтон, Г. Шривастава, Н .; Крижевский, А .; Суцкевер, Мен .; Салахутдинов, Р.Р. (2012). «Функционалды детекторлардың бірлесіп бейімделуіне жол бермеу арқылы нейрондық желілерді жетілдіру». arXiv:1207.0580 [math.LG ].

- ^ Епископ, Кристофер М. (2006). Үлгіні тану және машиналық оқыту (PDF). Спрингер. ISBN 978-0-387-31073-2.

- ^ Ивахненко, А.Г .; Лапа, В.Г. (1967). Кибернетика және болжау әдістері. American Elsevier Publishing Co. ISBN 978-0-444-00020-0.

- ^ а б Ивахненко, Алексей (1971). «Күрделі жүйелердің полиномдық теориясы» (PDF). IEEE жүйелер, адам және кибернетика бойынша транзакциялар. SMC-1 (4): 364-378. дои:10.1109 / TSMC.1971.4308320.

- ^ Фукусима, К. (1980). «Неокогнитрон: қалыптың ауысуына әсер етпейтін үлгіні тану тетігі үшін жүйенің өзін-өзі ұйымдастыратын моделі». Биол. Киберн. 36 (4): 193–202. дои:10.1007 / bf00344251. PMID 7370364. S2CID 206775608.

- ^ Рина Дечтер (1986). Шектеу-қанағаттану проблемаларын іздеу кезінде оқыту. Калифорния университеті, компьютерлік ғылымдар бөлімі, когнитивті жүйелер зертханасы.Желіде

- ^ Игорь Айзенберг, Наум Н. Айзенберг, Джоос П.Л. Vandewalle (2000). Көп мәнді және әмбебап екілік нейрондар: теория, оқыту және қолдану. Springer Science & Business Media.

- ^ Бірге дамып келе жатқан қайталанатын нейрондар терең есте сақтауды үйренеді POMDP. Proc. GECCO, Вашингтон, Д.С., 1795-1802 бет, ACM Press, Нью-Йорк, Нью-Йорк, АҚШ, 2005.

- ^ Сеппо Линнайнмаа (1970). Алгоритмнің жинақталған дөңгелектеу қателігінің Тейлордың жергілікті дөңгелектеу қателіктерінің кеңеюі ретінде көрінуі. Магистрлік диссертация (фин тілінде), Univ. Хельсинки, 6-7.

- ^ Griewank, Andreas (2012). «Дифференциацияның кері режимін кім ойлап тапты?» (PDF). Mathematica Documenta (ISMP қосымша томы): 389-400. Архивтелген түпнұсқа (PDF) 2017-07-21. Алынған 2017-06-11.

- ^ Werbos, P. (1974). «Регрессиядан тыс: мінез-құлық ғылымдарындағы болжам мен талдаудың жаңа құралдары». Гарвард университеті. Алынған 12 маусым 2017.

- ^ Вербос, Павел (1982). «Сызықтық емес сезімталдықты талдаудың жетістіктерін қолдану» (PDF). Жүйені модельдеу және оңтайландыру. Спрингер. 762–770 бет.

- ^ а б LeCun т.б., «Пошталық индексті тану үшін қолданылған көшіру,» Нейрондық есептеу, 1, 541-551 б., 1989 ж.

- ^ Дж.Венг, Н.Ахуджа және Т.С.Хуанг »Cresceptron: бейімделіп өсетін өздігінен ұйымдастырылатын жүйке жүйесі," Proc. Нейрондық желілер бойынша халықаралық бірлескен конференция, Балтимор, Мэриленд, I том, 576-581 бет, маусым, 1992.

- ^ Дж.Венг, Н.Ахуджа және Т.С.Хуанг »2-өлшемді кескіндерден 3-өлшемді объектілерді тануды және сегменттеуді үйрену," Proc. 4-ші халықаралық конф. Computer Vision, Берлин, Германия, 121-128 бб, 1993 ж. Мамыр.

- ^ Дж.Венг, Н.Ахуджа және Т.С.Хуанг »Cresceptron көмегімен оқуды тану және сегментациялау," Халықаралық компьютерлік көрініс журналы, т. 25, жоқ. 2, 105-139 б., 1997 ж. Қараша.

- ^ де Карвальо, Андре С. Л. Ф .; Фэйрхерст, Майк С .; Биссет, Дэвид (1994-08-08). «Үлгіні жіктеуге арналған бульдік жүйке жүйесі». Үлгіні тану хаттары. 15 (8): 807–813. дои:10.1016/0167-8655(94)90009-4.

- ^ Хинтон, Джеффри Э .; Даян, Петр; Фрей, Брендан Дж .; Нил, Рэдфорд (1995-05-26). «Бақыланбайтын нейрондық желілерге арналған ояту-ұйқы алгоритмі». Ғылым. 268 (5214): 1158–1161. Бибкод:1995Sci ... 268.1158H. дои:10.1126 / ғылым.7761831. PMID 7761831.

- ^ а б С. Хохрейтер., «Untersuchungen zu dynamischen neuronalen Netzen," Дипломдық жұмыс. Институт ф. Informatik, Technische Univ. Мюнхен. Кеңесші: Дж.Шмидубер, 1991.

- ^ Хохрейтер, С .; т.б. (15 қаңтар 2001). «Қайталанатын торлардағы градиент ағыны: ұзақ мерзімді тәуелділікті үйренудің қиындығы». Коленде Джон Ф .; Кремер, Стефан С. (ред.) Динамикалық қайталанатын желілерге арналған нұсқаулық. Джон Вили және ұлдары. ISBN 978-0-7803-5369-5.

- ^ Бехнке, Свен (2003). «Суретті интерпретациялауға арналған иерархиялық жүйке желілері». Информатика пәнінен дәрістер. дои:10.1007 / b11963. ISSN 0302-9743.

- ^ Морган, Нельсон; Бурлард, Эрво; Бүйрек, Стив; Коэн, Майкл; Франко, Орасио (1993-08-01). «Гибридті жүйке желісі / сөйлеуді үздіксіз тануға арналған жасырын маркалық модельдік жүйелер». Үлгіні танудың және жасанды интеллекттің халықаралық журналы. 07 (4): 899–916. дои:10.1142 / s0218001493000455. ISSN 0218-0014.

- ^ Робинсон, Т. (1992). «Нақты уақыттағы қайталанатын қателіктерді тарату жүйесі сөздерді тану жүйесі». ICASSP. Icassp'92: 617-66. ISBN 9780780305328.

- ^ Вайбель, А .; Ханазава, Т .; Хинтон, Г .; Шикано, К .; Lang, K. J. (наурыз 1989). «Нейрондық желілерді кідірту арқылы фонеманы тану» (PDF). IEEE акустика, сөйлеу және сигналды өңдеу бойынша транзакциялар. 37 (3): 328–339. дои:10.1109/29.21701. hdl:10338.dmlcz / 135496. ISSN 0096-3518.

- ^ Бейкер Дж .; Дэн, Ли; Шыны, Джим; Худанпур, С .; Ли, C.-H .; Морган, Н .; O'Shoughnessy, D. (2009). «Сөйлеуді тану мен түсінудегі зерттеулер мен бағыттар, 1 бөлім». IEEE сигналдарды өңдеу журналы. 26 (3): 75–80. Бибкод:2009ISPM ... 26 ... 75B. дои:10.1109 / msp.2009.932166. S2CID 357467.

- ^ Бенгио, Ю. (1991). «Жасанды жүйке желілері және оларды сөйлеуді / тізбекті тануға қолдану». McGill University Ph.D. тезис

- ^ Дэн, Л .; Хасанейн, К .; Elmasry, M. (1994). «Сөйлеуді тануға арналған қосымшалары бар жүйке болжамды моделі үшін корреляциялық құрылымды талдау». Нейрондық желілер. 7 (2): 331–339. дои:10.1016/0893-6080(94)90027-2.

- ^ Доддингтон, Г .; Пзыбокки, М .; Мартин, А .; Рейнольдс, Д. (2000). «NIST динамиктерін бағалауды бағалау ± Шолу, әдіснамасы, жүйелері, нәтижелері, перспективасы». Сөйлеу байланысы. 31 (2): 225–254. дои:10.1016 / S0167-6393 (99) 00080-1.

- ^ а б Хек, Л .; Кониг, Ю .; Сонмез, М .; Вайнтрауб, М. (2000). «Телефон тұтқасының дискриминациялық ерекшелігі бойынша динамиканы танудағы бұрмалаушылыққа деген сенімділігі». Сөйлеу байланысы. 31 (2): 181–192. дои:10.1016 / s0167-6393 (99) 00077-1.

- ^ «LVCSR үшін уақыт сигналын қолданатын терең жүйке желілерімен акустикалық модельдеу (PDF жүктеу қол жетімді)». ResearchGate. Алынған 2017-06-14.

- ^ а б c Хохрейтер, Сепп; Шмидубер, Юрген (1997-11-01). «Ұзақ мерзімді жады». Нейрондық есептеу. 9 (8): 1735–1780. дои:10.1162 / neco.1997.9.8.1735. ISSN 0899-7667. PMID 9377276. S2CID 1915014.

- ^ а б Грейвс, Алекс; Эк, Дуглас; Берингер, Николь; Шмидубер, Юрген (2003). «LSTM жүйке торларымен сөйлеуді биологиялық тұрғыдан түсіну» (PDF). 1-ші халықаралық Дамыған ақпараттық технологияларға биологиялық шабыттанған тәсілдер бойынша семинар, Bio-ADIT 2004, Лозанна, Швейцария. 175–184 бет.

- ^ а б Грейвс, Алекс; Фернандес, Сантьяго; Гомес, Фаустино (2006). «Коннекционистік уақытша классификация: қайталанатын жүйке желілерімен сегменттелмеген дәйектілік деректерін таңбалау». Машиналық оқыту бойынша халықаралық конференция материалдары, ICML 2006 ж: 369–376. CiteSeerX 10.1.1.75.6306.

- ^ Сантьяго Фернандес, Алекс Гравес және Юрген Шмидубер (2007). Қайталанатын нейрондық желілерді дискриминациялық кілт сөзді анықтауға қолдану. ICANN материалдары (2), 220–229 бб.

- ^ а б Сақ, Хашим; Аға, Эндрю; Рао, Канишка; Бофей, Франсуа; Шалквик, Йохан (қыркүйек 2015). «Google дауыстық іздеу: жылдамырақ және дәлірек».

- ^ Хинтон, Джеффри Э. (2007-10-01). «Көп қабатты бейнелеуді үйрену». Когнитивті ғылымдардың тенденциялары. 11 (10): 428–434. дои:10.1016 / j.tics.2007.09.004. ISSN 1364-6613. PMID 17921042. S2CID 15066318.

- ^ Хинтон, Г.Э.; Осиндеро, С .; Teh, Y. W. (2006). «Терең сенім торларын жылдам үйрену алгоритмі» (PDF). Нейрондық есептеу. 18 (7): 1527–1554. дои:10.1162 / neco.2006.18.7.1527. PMID 16764513. S2CID 2309950.

- ^ Бенгио, Йошуа (2012). «Терең архитектураларды градиенттік оқыту бойынша практикалық ұсыныстар». arXiv:1206.5533 [cs.LG ].

- ^ Г. Э. Хинтон. «Көп қабатты бейнелеуді үйрену," Когнитивті ғылымдардың тенденциялары, 11, 428–434 б., 2007 ж.

- ^ а б c Хинтон, Г .; Дэн, Л .; Ю, Д .; Даль, Г .; Мохамед, А .; Джейтли, Н .; Аға, А .; Ванхоуке, V .; Нгуен, П .; Сайнат Т .; Кингсбери, Б. (2012). «Сөйлеуді танудағы акустикалық модельдеуге арналған терең жүйке желілері: төрт зерттеу тобының ортақ көзқарастары». IEEE сигналдарды өңдеу журналы. 29 (6): 82–97. Бибкод:2012ISPM ... 29 ... 82H. дои:10.1109 / msp.2012.2205597. S2CID 206485943.

- ^ Дэн, Ли; Хинтон, Джеффри; Кингсбери, Брайан (1 мамыр 2013). «Сөйлеуді тану және оған қатысты қосымшалар үшін терең жүйке желісін оқытудың жаңа түрлері: шолу». Microsoft Research. CiteSeerX 10.1.1.368.1123 - research.microsoft.com арқылы.

- ^ Дэн, Ли; Ли, Джиню; Хуанг, Цзюй-Тин; Яо, Кайшэн; Ю, Донг; Сейде, Фрэнк; Сельцер, Майкл; Цвейг, Джеофф; Ол, Сяодун; Уильямс, Джейсон; Гонг, Йифан; Acero, Alex (2013). «Майкрософтта сөйлеуді зерттеу үшін терең білім берудегі соңғы жетістіктер». 2013 ж. IEEE акустика, сөйлеу және сигналдарды өңдеу бойынша халықаралық конференция. 8604–8608 беттер. дои:10.1109 / icassp.2013.6639345. ISBN 978-1-4799-0356-6. S2CID 13412186.

- ^ Сақ, Хасим; Аға, Эндрю; Beaufays, Francoise (2014). «Үлкен көлемді акустикалық модельдеуге арналған жүйенің ұзақ мерзімді жадының қайталанатын архитектурасы» (PDF). Архивтелген түпнұсқа (PDF) 2018-04-24.

- ^ Ли, Сянган; Ву, Сихонг (2014). «Үлкен сөздік сөйлеуді тану үшін ұзақ мерзімді жады негізінде терең қайталанатын жүйке желілерін құру». arXiv:1410.4281 [cs.CL ].

- ^ Дзен, Хейга; Сак, Хасим (2015). «Төмен кідірісті сөйлеу синтезі үшін қайталанатын шығыс қабаты бар бір бағытты ұзақ мерзімді жадының қайталанатын жүйке желісі» (PDF). Google.com. ICASSP. 4470–4474 бет.

- ^ Дэн, Л .; Абдель-Хамид, О .; Ю, Д. (2013). «Фонетикалық шатасумен акустикалық инвариантты саудалау үшін гетерогенді бассейнді қолданатын терең конволюциялық жүйке жүйесі» (PDF). Google.com. ICASSP.

- ^ а б Сайнат, Тара Н .; Мохамед, Абдель-Рахман; Кингсбери, Брайан; Рамабхадран, Бхувана (2013). «LVCSR үшін терең конволюциялық нейрондық желілер». 2013 ж. IEEE акустика, сөйлеу және сигналдарды өңдеу бойынша халықаралық конференция. 8614–8618 бет. дои:10.1109 / icassp.2013.6639347. ISBN 978-1-4799-0356-6. S2CID 13816461.

- ^ Янн ЛеКун (2016). Терең оқыту туралы слайдтар Желіде

- ^ а б c NIPS семинары: сөйлеуді тану және онымен байланысты қосымшаларды тереңдетіп оқыту, Уистлер, БК, Канада, 2009 ж. Желтоқсан (Ұйымдастырушылар: Ли Дэн, Джеофф Хинтон, Д. Ю).

- ^ а б Негізгі сөйлесу: Терең жүйке жүйесінің соңғы дамуы. ICASSP, 2013 (автор Джеофф Хинтон).

- ^ Д.Ю, Л.Денг, Г.Ли және Ф.Сейде (2011). «Терең нейрондық желілерді дискриминативті алдын-ала тексеру», АҚШ патенттік құжаттамасы.

- ^ а б c Дэн, Л .; Хинтон, Г .; Кингсбери, Б. (2013). «Сөйлеуді тану және соған байланысты қосымшалар үшін терең нейрондық желіні оқытудың жаңа түрлері: шолу (ICASSP)» (PDF). Журналға сілтеме жасау қажет

| журнал =(Көмектесіңдер) - ^ а б c Ю, Д .; Deng, L. (2014). Сөйлеуді автоматты түрде тану: терең оқыту әдісі (баспагері: Springer). ISBN 978-1-4471-5779-3.

- ^ «Денг IEEE беделді техникалық жетістік марапатын алды - Microsoft Research». Microsoft Research. 3 желтоқсан 2015.

- ^ а б Ли, Дэн (қыркүйек 2014). «Негізгі сөйлесу: 'Терең оқытудың жетістіктері мен қиындықтары - сөйлеуді талдау мен танудан тілге және мультимодальдық өңдеуге дейін'". Интерспик.

- ^ Ю, Д .; Дэн, Л. (2010). «Дүниежүзілік сөйлеуді тану үшін контекстке тәуелді DBN-HMM-дегі дайындық пен дәл баптаудың рөлі». Терең оқыту және бақылаусыз ерекшеліктерді оқыту бойынша NIPS семинары.

- ^ Сейде, Ф .; Ли Дж .; Ю, Д. (2011). «Контекстке байланысты терең нейрондық желілерді қолдана отырып, сөйлеу транскрипциясы». Интерспик.

- ^ Дэн, Ли; Ли, Джиню; Хуанг, Цзюй-Тин; Яо, Кайшэн; Ю, Донг; Сейде, Фрэнк; Сельцер, Майк; Цвейг, Джеофф; Ол, Сяодун (2013-05-01). «Майкрософтта сөйлеуді зерттеу үшін терең білім алудағы соңғы жетістіктер». Microsoft Research.

- ^ «Nvidia бас директоры терең оқыту мен VR-ге үлкен ставкалар қояды». Venture Beat. 2016 жылғы 5 сәуір.

- ^ «Жұмыс істемегеннен нейрондық желіге дейін». Экономист.

- ^ а б О, К.-С .; Джунг, К. (2004). «Нейрондық желілерді GPU енгізу». Үлгіні тану. 37 (6): 1311–1314. дои:10.1016 / j.patcog.2004.01.013.

- ^ "Графикалық процессорларда терең оқытуды оңтайландыру әдістеріне сауалнама «, С.Миттал және С.Вайшай, Журнал жүйелерінің архитектурасы, 2019 ж

- ^ а б Челлапилла, К., Пури, С. және Симард, П. (2006). Құжаттарды өңдеуге арналған жоғары өнімді конволюциялық жүйке желілері. Қолжазбаны танудағы шекара бойынша халықаралық семинар.

- ^ Кирешан, Дэн Клаудиу; Мейер, Уели; Гамбарделла, Лука Мария; Шмидубер, Юрген (2010-09-21). «Қолмен жазылған цифрды тануға арналған терең, үлкен, қарапайым жүйке торлары». Нейрондық есептеу. 22 (12): 3207–3220. arXiv:1003.0358. дои:10.1162 / neco_a_00052. ISSN 0899-7667. PMID 20858131. S2CID 1918673.

- ^ Раина, Раджат; Мадхаван, Ананд; Нг, Эндрю Ю. (2009). «Графикалық процессорларды қолдана отырып, ауқымды терең бақылаусыз оқыту». Машиналық оқыту бойынша 26-шы жыл сайынғы халықаралық конференция материалдары. ICML '09. Нью-Йорк, Нью-Йорк, АҚШ: ACM: 873–880. CiteSeerX 10.1.1.154.372. дои:10.1145/1553374.1553486. ISBN 9781605585161. S2CID 392458.

- ^ Сзе, Вивьен; Чен, Ю-Син; Ян, Тянь-Джу; Эмер, Джоэль (2017). «Терең жүйке торларын тиімді өңдеу: оқулық және сауалнама». arXiv:1703.09039 [cs.CV ].

- ^ а б «Merck молекулалық қызметіне шақыру». kaggle.com.

- ^ а б «QSAR болжауына арналған көп мақсатты жүйке желілері | Data Science Association». www.datascienceassn.org. Алынған 2017-06-14.

- ^ а б «ХХІ ғасырдағы токсикология Data Challenge»

- ^ а б «NCATS Tox21 Data Challenge жеңімпаздарын жариялайды».

- ^ а б «Мұрағатталған көшірме». Архивтелген түпнұсқа 2015-02-28. Алынған 2015-03-05.CS1 maint: тақырып ретінде мұрағатталған көшірме (сілтеме)

- ^ Киресан, Д. С .; Мейер, У .; Масчи Дж .; Гамбарделла, Л.М .; Шмидубер, Дж. (2011). «Бейнелерді жіктеуге арналған икемді, жоғары өнімді конволюциялық жүйке желілері» (PDF). Жасанды интеллект бойынша халықаралық бірлескен конференция. дои:10.5591 / 978-1-57735-516-8 / ijcai11-210.

- ^ Киресан, Дэн; Джусти, Алессандро; Гамбарделла, Лука М .; Шмидубер, Юрген (2012). Перейра, Ф .; Бургес, Дж. Дж .; Ботту, Л .; Вайнбергер, К.Қ. (ред.) 25. Жүйке ақпаратын өңдеу жүйесіндегі жетістіктер (PDF). Curran Associates, Inc., 2843–2851 беттер.

- ^ Киресан, Д .; Джусти, А .; Гамбарделла, Л.М .; Шмидубер, Дж. (2013). «Терең нейрондық желілерді қолдана отырып, сүт безі обырының гистологиялық суреттерінде митозды анықтау». MICCAI материалдары. Информатика пәнінен дәрістер. 7908 (Pt 2): 411-418. дои:10.1007/978-3-642-40763-5_51. ISBN 978-3-642-38708-1. PMID 24579167.

- ^ «Wolfram тілінің кескінін анықтау жобасы». www.imageidentify.com. Алынған 2017-03-22.

- ^ Виниалс, Ориол; Тошев, Александр; Бенгио, Сами; Эрхан, Думитру (2014). «Көрсетіңіз және айтыңыз: суреттің титрының жүйкелік генераторы». arXiv:1411.4555 [cs.CV ]..

- ^ Азу, Хао; Гупта, Саурабх; Иандола, Форрест; Шривастава, Рупеш; Дэн, Ли; Доллар, Пиотр; Гао, Цзянфэн; Ол, Сяодун; Митчелл, Маргарет; Платт, Джон С; Лоуренс Цитник, С; Цвейг, Джеффри (2014). «Тақырыптардан визуалды түсініктерге және кері». arXiv:1411.4952 [cs.CV ]..

- ^ Кирос, Райан; Салахутдинов, Руслан; Земел, Ричард С (2014). «Визуалды-семантикалық ендіруді мультимодальды нейрондық тіл модельдерімен біріктіру». arXiv:1411.2539 [cs.LG ]..

- ^ Чжун, Шэн-хуа; Лю, Ян; Лю, Ян (2011). «Суреттерді классификациялауға арналған екі деңгейлі терең оқыту». Мультимедиа бойынша 19 ACM халықаралық конференциясының материалдары. MM '11. Нью-Йорк, Нью-Йорк, АҚШ: ACM: 343–352. дои:10.1145/2072298.2072344. hdl:10397/23574. ISBN 9781450306164. S2CID 11922007.

- ^ «Неліктен терең білім сіздің өміріңізді кенеттен өзгертеді». Сәттілік. 2016. Алынған 13 сәуір 2018.

- ^ Күміс, Дэвид; Хуанг, Аджа; Маддисон, Крис Дж .; Гуез, Артур; Сифре, Лоран; Дришше, Джордж ван ден; Шриттвизер, Джулиан; Антоноглау, Иоаннис; Паннершелвам, Веда (қаңтар 2016). «Терең нейрондық желілермен және ағаш іздеумен Go ойынын меңгеру». Табиғат. 529 (7587): 484–489. Бибкод:2016 ж. 529..484S. дои:10.1038 / табиғат 16961. ISSN 1476-4687. PMID 26819042. S2CID 515925.

- ^ Терең оқыту және нейрондық желілерге арналған нұсқаулық

- ^ Сегеди, христиан; Тошев, Александр; Эрхан, Думитру (2013). «Нысандарды анықтауға арналған терең жүйке желілері». Нейрондық ақпаратты өңдеу жүйесіндегі жетістіктер: 2553–2561.

- ^ Хоф, Роберт Д. «Жасанды интеллект ақыры өз-өзіне келе ме?». MIT Technology шолуы. Алынған 2018-07-10.

- ^ а б Герс, Феликс А .; Шмидубер, Юрген (2001). «LSTM қайталанатын желілері қарапайым мәтінмәнді және мәнмәтінді сезімтал тілдерді үйренеді». IEEE жүйелеріндегі транзакциялар. 12 (6): 1333–1340. дои:10.1109/72.963769. PMID 18249962.

- ^ а б c Суцкевер, Л .; Виньялс, О .; Le, Q. (2014). «Нейрондық желілермен оқытудың жүйелілігі» (PDF). Proc. NIPS. arXiv:1409.3215. Бибкод:2014arXiv1409.3215S.

- ^ а б Йозефович, Рафал; Виниалс, Ориол; Шустер, Майк; Шейзер, Ноам; Ву, Ёнхуэй (2016). «Тілдерді модельдеу шектерін зерттеу». arXiv:1602.02410 [cs.CL ].

- ^ а б Джиллик, Дэн; Бранк, Клифф; Виниалс, Ориол; Субрамания, Амарнаг (2015). «Байттан көп тілді өңдеу». arXiv:1512.00103 [cs.CL ].

- ^ Миколов, Т .; т.б. (2010). «Жүйеге негізделген жүйенің қайталанатын моделі» (PDF). Интерспик.

- ^ а б «LSTM қайталанатын желілерімен нақты уақытты үйрену (PDF жүктеу қол жетімді)». ResearchGate. Алынған 2017-06-13.

- ^ ЛеКун, Ю .; т.б. (1998). «Құжаттарды тануға қолданылатын градиенттік оқыту». IEEE материалдары. 86 (11): 2278–2324. дои:10.1109/5.726791.

- ^ Бенгио, Йошуа; Буланжер-Левандовски, Николас; Паскану, Разван (2013). «Қайталанатын желілерді оңтайландырудағы жетістіктер». 2013 ж. IEEE акустика, сөйлеу және сигналдарды өңдеу бойынша халықаралық конференция. 8624–8628 бет. arXiv:1212.0901. CiteSeerX 10.1.1.752.9151. дои:10.1109 / icassp.2013.6639349. ISBN 978-1-4799-0356-6. S2CID 12485056.

- ^ Даль, Г .; т.б. (2013). «LVCSR үшін DNN-ді түзетілген сызықтық қондырғылар мен оқудан босатуды қолдану арқылы жетілдіру» (PDF). ICASSP.

- ^ «Деректерді ұлғайту - deeplearning.ai | Coursera». Курсера. Алынған 2017-11-30.

- ^ Хинтон, Г.Э. (2010). «Шектелген Больцман машиналарын оқытуға арналған практикалық нұсқаулық». Техникалық. UTML TR 2010-003 жауап.

- ^ Сіз, Ян; Булуч, Айдын; Деммел, Джеймс (қараша 2017). «ГПУ және рыцарьлардың қонуға кластерлерін тереңдетіп оқытуды кеңейту». SC '17 жоғары өнімділікті есептеу, желілік байланыс, сақтау және талдау жөніндегі халықаралық конференция материалдары. SC '17, ACM. 1-12 бет. дои:10.1145/3126908.3126912. ISBN 9781450351140. S2CID 8869270. Алынған 5 наурыз 2018.

- ^ Вибке, Андре; Мемети, Суежб; Пллана, Сабри; Авраам, Аджит (2019). «ХАОС: Intel Xeon Phi-де конволюциялық нейрондық желілерді оқытуға арналған параллелизация схемасы». Суперкомпьютер журналы. 75: 197–227. arXiv:1702.07908. Бибкод:2017arXiv170207908V. дои:10.1007 / s11227-017-1994-x. S2CID 14135321.

- ^ Тин Цинь және басқалар. «RLS негізінде CMAC оқыту алгоритмі». Нейрондық өңдеу хаттары 19.1 (2004): 49-61.

- ^ Тин Цинь және басқалар. «Үздіксіз CMAC-QRLS және оның систолалық жиымы. «Нейрондық өңдеу хаттары 22.1 (2005): 1-16.

- ^ Зерттеу, AI (23 қазан 2015). «Сөйлеуді тану кезінде акустикалық модельдеуге арналған терең жүйке желілері». airesearch.com. Алынған 23 қазан 2015.

- ^ «Графикалық процессорлар қазіргі уақытта AI акселераторлар нарығында үстемдік етуді жалғастыруда». Ақпараттық апта. Желтоқсан 2019. Алынған 11 маусым 2020.

- ^ Рэй, Тирнан (2019). «AI есептеудің барлық сипатын өзгертеді». ZDNet. Алынған 11 маусым 2020.

- ^ «AI және есептеу». OpenAI. 16 мамыр 2018 ж. Алынған 11 маусым 2020.

- ^ TIMIT Акустикалық-фонетикалық үздіксіз сөйлеу корпусы Тілдік мәліметтер консорциумы, Филадельфия.

- ^ Робинсон, Тони (30 қыркүйек 1991 ж.). «Желідегі телефонды тану жүйесінде қайталанатын қателіктер тарату жүйесін бірнеше жақсарту». Кембридж университетінің инженерлік бөлімінің техникалық есебі. CUED / F-INFENG / TR82. дои:10.13140 / RG.2.2.15418.90567.

- ^ Абдель-Хамид, О .; т.б. (2014). «Сөйлеуді тануға арналған конволюциялық жүйке желілері». Аудио, сөйлеу және тілді өңдеу бойынша IEEE / ACM транзакциялары. 22 (10): 1533–1545. дои:10.1109 / taslp.2014.2339736. S2CID 206602362.

- ^ Дэн, Л .; Платт, Дж. (2014). «Сөйлеуді тану үшін терең оқыту ансамблі». Proc. Интерспик. S2CID 15641618.

- ^ Тот, Ласло (2015). «Иерархиялық конволюциялық терең Maxout желілерімен телефонды тану» (PDF). Аудио, сөйлеу және музыканы өңдеу бойынша EURASIP журналы. 2015. дои:10.1186 / s13636-015-0068-3. S2CID 217950236.

- ^ Макмиллан, Роберт (2014-12-17). «Skype өзінің таңғажайып жаңа аудармашысын құру үшін AI-ді қалай қолданды | СЫРЛАНДЫ». Сымды. Алынған 2017-06-14.

- ^ Ханнун, Авни; Кейс, Карл; Каспер, Джаред; Катанзаро, Брайан; Диамос, Грег; Элсен, Эрих; Пренгер, Райан; Сәтеш, Санжеев; Сенгупта, Шубхо; Пальшалар, Адам; Нг, Эндрю Y (2014). «Терең сөйлеу: сөйлеуді аяғына дейін танудың ауқымын арттыру». arXiv:1412.5567 [cs.CL ].

- ^ Джафарзаде, Мохсен; Гусси, Дэниел Кертисс; Тадессе, Йонас (2019). Қолды протездеуді электромиографиялық сигналдармен басқаруға терең оқыту әдісі. 2019 IEEE Халықаралық робототехникада өлшеу және басқару жөніндегі симпозиум (ISMCR). IEEE. A1-4 бет. arXiv:1909.09910. дои:10.1109 / ISMCR47492.2019.8955725.

- ^ «MNIST қолымен жазылған цифрлы мәліметтер базасы, Янн ЛеКун, Коринна Кортес және Крис Бургес». yann.lecun.com.

- ^ Кирешан, Дэн; Мейер, Уели; Масчи, Джонатан; Шмидубер, Юрген (тамыз 2012). «Жол белгілерін жіктеуге арналған көп бағаналы терең нейрондық желі». Нейрондық желілер. IJCNN 2011 таңдалған құжаттар. 32: 333–338. CiteSeerX 10.1.1.226.8219. дои:10.1016 / j.neunet.2012.02.023. PMID 22386783.

- ^ Nvidia «терең оқыту» әдісімен оқытылған компьютерлік машинаны ұсынады (2015-01-06), Дэвид Талбот, MIT Technology шолуы

- ^ Дж. В.Смит; Фредерик Фол Леймари (10 сәуір 2017). «Суретші ретінде машина: кіріспе». Өнер. 6 (4): 5. дои:10.3390 / art6020005.

- ^ Blaise Agüera y Arcas (29 қыркүйек 2017). «Өнер машиналық интеллект дәуірінде». Өнер. 6 (4): 18. дои:10.3390 / art6040018.

- ^ Голдберг, Йоав; Леви, Омар (2014). «word2vec түсіндірілді: Миколовтың және басқалардың сөздерді енгізу әдісін терістеу». arXiv:1402.3722 [cs.CL ].

- ^ а б Сохер, Ричард; Мэннинг, Кристофер. «NLP үшін терең оқыту» (PDF). Алынған 26 қазан 2014.

- ^ Сохер, Ричард; Бауэр, Джон; Мэннинг, Кристофер; Нг, Эндрю (2013). «Композициялық векторлық грамматикамен талдау» (PDF). ACL 2013 конференциясының материалдары.

- ^ Socher, Richard (2013). «Сезім ағашының жағасында семантикалық композицияның рекурсивті терең модельдері» (PDF). Журналға сілтеме жасау қажет

| журнал =(Көмектесіңдер) - ^ Шен, Йелонг; Ол, Сяодун; Гао, Цзянфэн; Дэн, Ли; Меснил, Грегуар (2014-11-01). «Ақпаратты іздеу үшін конволюциялық-жинақтау құрылымы бар жасырын семантикалық модель». Microsoft Research.

- ^ Хуанг, По-Сен; Ол, Сяодун; Гао, Цзянфэн; Дэн, Ли; Acero, Alex; Хек, Ларри (2013-10-01). «Веб-іздеу үшін терең құрылымдық семантикалық модельдерді басу арқылы деректерді пайдалану арқылы үйрену». Microsoft Research.

- ^ Меснил, Г .; Дофин, Ю .; Яо, К .; Бенгио, Ю .; Дэн, Л .; Хаккани-Тур, Д .; Ол, Х .; Хек, Л .; Тур, Г .; Ю, Д .; Цвейг, Г. (2015). «Ауызекі тілді түсінуге слоттарды толтыру үшін қайталанатын нейрондық желілерді қолдану». IEEE транзакциясы аудио, сөйлеу және тілді өңдеу бойынша. 23 (3): 530–539. дои:10.1109 / taslp.2014.2383614. S2CID 1317136.

- ^ а б Гао, Цзянфэн; Ол, Сяодун; Их, Скотт Вен-тау; Дэн, Ли (2014-06-01). «Аударманы модельдеу үшін үздіксіз сөз тіркестерін үйрену». Microsoft Research.

- ^ Брокардо, Марсело Луис; Траоре, Исса; Вунганг, Ысқақ; Обайдат, Мұхаммед С. (2017). «Терең сенім жүйелерін қолдана отырып авторлықты тексеру». Халықаралық байланыс жүйелері журналы. 30 (12): e3259. дои:10.1002 / dac.3259.

- ^ «Табиғи тілді өңдеу үшін терең білім: теория мен практика (CIKM2014 оқулығы) - Microsoft Research». Microsoft Research. Алынған 2017-06-14.

- ^ Туровский, Барак (15.11.2016). «Аудармада табылды: Google Translate-те дәлірек, еркін сөйлемдер». Google Blog кілт сөзі. Алынған 23 наурыз, 2017.

- ^ а б c г. Шустер, Майк; Джонсон, Мелвин; Торат, Никхил (22 қараша, 2016). «Google-дің нейрондық автоматты аударма жүйесімен нөлдік аударма». Google зерттеу блогы. Алынған 23 наурыз, 2017.

- ^ Сепп Хохрейтер; Юрген Шмидубер (1997). «Ұзақ мерзімді жады». Нейрондық есептеу. 9 (8): 1735–1780. дои:10.1162 / neco.1997.9.8.1735. PMID 9377276. S2CID 1915014.

- ^ Феликс А.Герс; Юрген Шмидубер; Фред Камминс (2000). «Ұмытуды үйрену: LSTM көмегімен үздіксіз болжам». Нейрондық есептеу. 12 (10): 2451–2471. CiteSeerX 10.1.1.55.5709. дои:10.1162/089976600300015015. PMID 11032042. S2CID 11598600.

- ^ Ву, Юнхуэй; Шустер, Майк; Чен, Чифэн; Le, Quoc V; Норузи, Мұхаммед; Мачери, Вольфганг; Крикун, Максим; Цао, Юань; Гао, Цинь; Мачерей, Клаус; Клингнер, Джефф; Шах, Апурва; Джонсон, Мелвин; Лю, Сяобин; Кайзер, Чукас; Гувс, Стефан; Като, Йошикиё; Кудо, Таку; Казава, Хидето; Стивенс, Кит; Куриан, Джордж; Патил, Нишант; Ван, Вэй; Жас, Клифф; Смит, Джейсон; Риеса, Джейсон; Рудник, Алекс; Виниалс, Ориол; Коррадо, Грег; т.б. (2016). «Google-дің нейрондық машиналық аударма жүйесі: адам мен машинадағы аударма арасындағы айырмашылықты жою». arXiv:1609.08144 [cs.CL ].

- ^ Metz, Cade (2016 жылғы 27 қыркүйек). «AI инфузиясы Google Translate-ті бұрынғыдан да қуатты етеді». Сымды.

- ^ а б Бойте, христиан; Бланчон, Эрве; Селигман, Марк; Беллинк, Валери (2010). «Интернетке арналған және MT» (PDF). Алынған 1 желтоқсан, 2016.